| –Ę–Ķ–ĺ—Ä–ł—Ź –ł–Ĺ—Ą–ĺ—Ä–ľ–į—Ü–ł–ł |

|---|

|

|

|

|

–Ę–Ķ–ĺ—Ä–Ķ–ľ–į –®–Ķ–Ĺ–Ĺ–ĺ–Ĺ–į –ī–Ľ—Ź –ļ–į–Ĺ–į–Ľ–į –Ī–Ķ–∑ —ą—É–ľ–į (—ā–Ķ–ĺ—Ä–Ķ–ľ–į –ļ–ĺ–ī–ł—Ä–ĺ–≤–į–Ĺ–ł—Ź –ī–Ľ—Ź –ī–ł—Ā–ļ—Ä–Ķ—ā–Ĺ–ĺ–≥–ĺ –ļ–į–Ĺ–į–Ľ–į –Ī–Ķ–∑ —ą—É–ľ–į[1], —ā–Ķ–ĺ—Ä–Ķ–ľ–į –®–Ķ–Ĺ–Ĺ–ĺ–Ĺ–į –ĺ –ļ–ĺ–ī–ł—Ä–ĺ–≤–į–Ĺ–ł–ł –ł—Ā—ā–ĺ—á–Ĺ–ł–ļ–į[2], –Ņ–Ķ—Ä–≤–į—Ź —ā–Ķ–ĺ—Ä–Ķ–ľ–į –®–Ķ–Ĺ–Ĺ–ĺ–Ĺ–į –ī–Ľ—Ź –ļ–į–Ĺ–į–Ľ–į –Ī–Ķ–∑ —ą—É–ľ–į[3]) ‚ÄĒ —ā–Ķ–ĺ—Ä–Ķ–ľ–į, –ļ–ĺ—ā–ĺ—Ä–į—Ź –ĺ–Ņ—Ä–Ķ–ī–Ķ–Ľ—Ź–Ķ—ā –ľ–į–ļ—Ā–ł–ľ–į–Ľ—Ć–Ĺ—É—é —Ā–ļ–ĺ—Ä–ĺ—Ā—ā—Ć –Ņ–Ķ—Ä–Ķ–ī–į—á–ł —Ā–ł–ľ–≤–ĺ–Ľ–ĺ–≤ (—Ā–ĺ–ĺ–Ī—Č–Ķ–Ĺ–ł–Ļ) –ł—Ā—ā–ĺ—á–Ĺ–ł–ļ–į –≤ –ļ–į–Ĺ–į–Ľ–Ķ –Ī–Ķ–∑ —ą—É–ľ–į[4]. –ü—Ä–ł —Ą–ł–ļ—Ā–ł—Ä–ĺ–≤–į–Ĺ–Ĺ–ĺ–Ļ —Ā–ļ–ĺ—Ä–ĺ—Ā—ā–ł –Ņ–Ķ—Ä–Ķ–ī–į—á–ł —Ā–ł–ľ–≤–ĺ–Ľ–ĺ–≤, –ĺ–Ņ—Ä–Ķ–ī–Ķ–Ľ—Ź–Ķ—ā –ľ–į–ļ—Ā–ł–ľ–į–Ľ—Ć–Ĺ—É—é –Ņ—Ä–ĺ–ł–∑–≤–ĺ–ī–ł—ā–Ķ–Ľ—Ć–Ĺ–ĺ—Ā—ā—Ć –ł—Ā—ā–ĺ—á–Ĺ–ł–ļ–į (—ć–Ĺ—ā—Ä–ĺ–Ņ–ł—é –≤ –Ķ–ī–ł–Ĺ–ł—Ü—É –≤—Ä–Ķ–ľ–Ķ–Ĺ–ł), –Ņ—Ä–ł –ļ–ĺ—ā–ĺ—Ä–ĺ–Ļ –ľ–ĺ–∂–Ĺ–ĺ –∑–į–ļ–ĺ–ī–ł—Ä–ĺ–≤–į—ā—Ć —Ā–ł–ľ–≤–ĺ–Ľ—č –Ĺ–į –≤—č—Ö–ĺ–ī–Ķ –ł—Ā—ā–ĺ—á–Ĺ–ł–ļ–į —ā–į–ļ–ł–ľ –ĺ–Ī—Ä–į–∑–ĺ–ľ, —á—ā–ĺ–Ī—č –Ņ–Ķ—Ä–Ķ–ī–į–≤–į—ā—Ć –ł—Ö —Ā–ļ–ĺ–Ľ—Ć —É–≥–ĺ–ī–Ĺ–ĺ —ā–ĺ—á–Ĺ–ĺ –Ņ–ĺ –ī–ł—Ā–ļ—Ä–Ķ—ā–Ĺ–ĺ–ľ—É –ļ–į–Ĺ–į–Ľ—É –Ī–Ķ–∑ —ą—É–ľ–į, –ł—Ā—Ö–ĺ–ī—Ź –ł–∑ –ł–∑–≤–Ķ—Ā—ā–Ĺ–ĺ–Ļ –Ņ—Ä–ĺ–Ņ—É—Ā–ļ–Ĺ–ĺ–Ļ —Ā–Ņ–ĺ—Ā–ĺ–Ī–Ĺ–ĺ—Ā—ā–ł –ļ–į–Ĺ–į–Ľ–į[5].

–Ę–į–ļ–∂–Ķ —ā–Ķ–ĺ—Ä–Ķ–ľ–į –ĺ–Ņ—Ä–Ķ–ī–Ķ–Ľ—Ź–Ķ—ā –Ĺ–į–ł–ľ–Ķ–Ĺ—Ć—ą–Ķ–Ķ —Ā—Ä–Ķ–ī–Ĺ–Ķ–Ķ —á–ł—Ā–Ľ–ĺ –ļ–ĺ–ī–ĺ–≤—č—Ö —Ā–ł–ľ–≤–ĺ–Ľ–ĺ–≤, –Ņ—Ä–ł—Ö–ĺ–ī—Ź—Č–ł—Ö—Ā—Ź –Ĺ–į –ĺ–ī–ł–Ĺ —Ā–ł–ľ–≤–ĺ–Ľ (—Ā–ĺ–ĺ–Ī—Č–Ķ–Ĺ–ł–Ķ) –ł—Ā—ā–ĺ—á–Ĺ–ł–ļ–į, –ļ–ĺ—ā–ĺ—Ä—č–ľ–ł –ľ–ĺ–∂–Ķ—ā –Ī—č—ā—Ć –∑–į–ļ–ĺ–ī–ł—Ä–ĺ–≤–į–Ĺ–į –ł–Ĺ—Ą–ĺ—Ä–ľ–į—Ü–ł—Ź –ł—Ā—ā–ĺ—á–Ĺ–ł–ļ–į –Ī–Ķ–∑ –Ņ–ĺ—ā–Ķ—Ä—Ć[6].

–Ę–Ķ–ĺ—Ä–Ķ–ľ—č

–ě –Ĺ–į–ł–ľ–Ķ–Ĺ—Ć—ą–Ķ–ľ —Ā—Ä–Ķ–ī–Ĺ–Ķ–ľ —á–ł—Ā–Ľ–Ķ –ļ–ĺ–ī–ĺ–≤—č—Ö —Ā–ł–ľ–≤–ĺ–Ľ–ĺ–≤ –Ĺ–į —Ā–ł–ľ–≤–ĺ–Ľ –ł—Ā—ā–ĺ—á–Ĺ–ł–ļ–į

–Ē–Ľ—Ź —Ā–Ľ—É—á–į—Ź, –Ķ—Ā–Ľ–ł –Ņ—Ä–ĺ–ł–∑–≤–ĺ–ī–ł—ā—Ć –ļ–ĺ–ī–ł—Ä–ĺ–≤–į–Ĺ–ł–Ķ —Ā–ł–ľ–≤–ĺ–Ľ–ĺ–≤ –ł—Ā—ā–ĺ—á–Ĺ–ł–ļ–į –Ņ–ĺ—Ā–ł–ľ–≤–ĺ–Ľ—Ć–Ĺ–ĺ, —ā–ĺ –Ķ—Ā—ā—Ć –ĺ—ā–ī–Ķ–Ľ—Ć–Ĺ–ĺ –ļ–ĺ–ī–ł—Ä–ĺ–≤–į—ā—Ć –ļ–į–∂–ī—č–Ļ —Ā–ł–ľ–≤–ĺ–Ľ –ł—Ā—ā–ĺ—á–Ĺ–ł–ļ–į, –†–ĺ–Ī–Ķ—Ä—ā –§–į–Ĺ–ĺ –≤ 1961 –≥–ĺ–ī—É —Ā—Ą–ĺ—Ä–ľ—É–Ľ–ł—Ä–ĺ–≤–į–Ľ –ĺ—Ā–Ĺ–ĺ–≤–Ĺ—É—é —ā–Ķ–ĺ—Ä–Ķ–ľ—É –ļ–ĺ–ī–ł—Ä–ĺ–≤–į–Ĺ–ł—Ź —Ā–Ľ–Ķ–ī—É—é—Č–ł–ľ –ĺ–Ī—Ä–į–∑–ĺ–ľ[7]:

–ü—Ä–ł –∑–į–ī–į–Ĺ–Ĺ–ĺ–ľ –į–Ĺ—Ā–į–ľ–Ī–Ľ–Ķ  –ł–∑

–ł–∑  —Ā–ĺ–ĺ–Ī—Č–Ķ–Ĺ–ł–Ļ (—Ā–ł–ľ–≤–ĺ–Ľ–ĺ–≤) —Ā —ć–Ĺ—ā—Ä–ĺ–Ņ–ł–Ķ–Ļ

—Ā–ĺ–ĺ–Ī—Č–Ķ–Ĺ–ł–Ļ (—Ā–ł–ľ–≤–ĺ–Ľ–ĺ–≤) —Ā —ć–Ĺ—ā—Ä–ĺ–Ņ–ł–Ķ–Ļ  –ł –į–Ľ—Ą–į–≤–ł—ā–ĺ–ľ, —Ā–ĺ—Ā—ā–ĺ—Ź—Č–Ķ–ľ –ł–∑

–ł –į–Ľ—Ą–į–≤–ł—ā–ĺ–ľ, —Ā–ĺ—Ā—ā–ĺ—Ź—Č–Ķ–ľ –ł–∑  —Ā–ł–ľ–≤–ĺ–Ľ–ĺ–≤, –≤–ĺ–∑–ľ–ĺ–∂–Ĺ–ĺ —ā–į–ļ –∑–į–ļ–ĺ–ī–ł—Ä–ĺ–≤–į—ā—Ć —Ā–ĺ–ĺ–Ī—Č–Ķ–Ĺ–ł—Ź (—Ā–ł–ľ–≤–ĺ–Ľ—č) –į–Ĺ—Ā–į–ľ–Ī–Ľ—Ź –Ņ–ĺ—Ā—Ä–Ķ–ī—Ā—ā–≤–ĺ–ľ –Ņ–ĺ—Ā–Ľ–Ķ–ī–ĺ–≤–į—ā–Ķ–Ľ—Ć–Ĺ–ĺ—Ā—ā–ł —Ā–ł–ľ–≤–ĺ–Ľ–ĺ–≤, –Ņ—Ä–ł–Ĺ–į–ī–Ľ–Ķ–∂–į—Č–ł—Ö –∑–į–ī–į–Ĺ–Ĺ–ĺ–ľ—É –į–Ľ—Ą–į–≤–ł—ā—É, —á—ā–ĺ —Ā—Ä–Ķ–ī–Ĺ–Ķ–Ķ —á–ł—Ā–Ľ–ĺ —Ā–ł–ľ–≤–ĺ–Ľ–ĺ–≤ –Ĺ–į —Ā–ĺ–ĺ–Ī—Č–Ķ–Ĺ–ł–Ķ (—Ā–ł–ľ–≤–ĺ–Ľ)

—Ā–ł–ľ–≤–ĺ–Ľ–ĺ–≤, –≤–ĺ–∑–ľ–ĺ–∂–Ĺ–ĺ —ā–į–ļ –∑–į–ļ–ĺ–ī–ł—Ä–ĺ–≤–į—ā—Ć —Ā–ĺ–ĺ–Ī—Č–Ķ–Ĺ–ł—Ź (—Ā–ł–ľ–≤–ĺ–Ľ—č) –į–Ĺ—Ā–į–ľ–Ī–Ľ—Ź –Ņ–ĺ—Ā—Ä–Ķ–ī—Ā—ā–≤–ĺ–ľ –Ņ–ĺ—Ā–Ľ–Ķ–ī–ĺ–≤–į—ā–Ķ–Ľ—Ć–Ĺ–ĺ—Ā—ā–ł —Ā–ł–ľ–≤–ĺ–Ľ–ĺ–≤, –Ņ—Ä–ł–Ĺ–į–ī–Ľ–Ķ–∂–į—Č–ł—Ö –∑–į–ī–į–Ĺ–Ĺ–ĺ–ľ—É –į–Ľ—Ą–į–≤–ł—ā—É, —á—ā–ĺ —Ā—Ä–Ķ–ī–Ĺ–Ķ–Ķ —á–ł—Ā–Ľ–ĺ —Ā–ł–ľ–≤–ĺ–Ľ–ĺ–≤ –Ĺ–į —Ā–ĺ–ĺ–Ī—Č–Ķ–Ĺ–ł–Ķ (—Ā–ł–ľ–≤–ĺ–Ľ)  —É–ī–ĺ–≤–Ľ–Ķ—ā–≤–ĺ—Ä—Ź–Ķ—ā —Ā–Ľ–Ķ–ī—É—é—Č–Ķ–ľ—É –Ĺ–Ķ—Ä–į–≤–Ķ–Ĺ—Ā—ā–≤—É:

—É–ī–ĺ–≤–Ľ–Ķ—ā–≤–ĺ—Ä—Ź–Ķ—ā —Ā–Ľ–Ķ–ī—É—é—Č–Ķ–ľ—É –Ĺ–Ķ—Ä–į–≤–Ķ–Ĺ—Ā—ā–≤—É:

–ß–ł—Ā–Ľ–ĺ  –Ĺ–Ķ –ľ–ĺ–∂–Ķ—ā –Ī—č—ā—Ć —Ā–ī–Ķ–Ľ–į–Ĺ–ĺ –ľ–Ķ–Ĺ—Ć—ą–Ķ, —á–Ķ–ľ

–Ĺ–Ķ –ľ–ĺ–∂–Ķ—ā –Ī—č—ā—Ć —Ā–ī–Ķ–Ľ–į–Ĺ–ĺ –ľ–Ķ–Ĺ—Ć—ą–Ķ, —á–Ķ–ľ  .

.

–Ę–į–ļ–į—Ź —Ą–ĺ—Ä–ľ—É–Ľ–ł—Ä–ĺ–≤–ļ–į –ľ–ĺ–∂–Ķ—ā –Ĺ–į–∑—č–≤–į—ā—Ć—Ā—Ź —ā–Ķ–ĺ—Ä–Ķ–ľ–ĺ–Ļ –®–Ķ–Ĺ–Ĺ–ĺ–Ĺ–į –ī–Ľ—Ź –ł—Ā—ā–ĺ—á–Ĺ–ł–ļ–į –ĺ–Ī—Č–Ķ–≥–ĺ –≤–ł–ī–į[8].

–ē—Ā–Ľ–ł –ĺ–Ī—ä–Ķ–ī–ł–Ĺ—Ź—ā—Ć —Ā–ł–ľ–≤–ĺ–Ľ—č –ł—Ā—ā–ĺ—á–Ĺ–ł–ļ–į –≤ –≥—Ä—É–Ņ–Ņ—č –Ņ–ĺ  —Ā–ł–ľ–≤–ĺ–Ľ–ĺ–≤ –ł –Ņ—Ä–ĺ–ł–∑–≤–ĺ–ī–ł—ā—Ć –ļ–ĺ–ī–ł—Ä–ĺ–≤–į–Ĺ–ł–Ķ —ć—ā–ł—Ö –≥—Ä—É–Ņ–Ņ –Ņ–ĺ—Ā–Ľ–Ķ–ī–ĺ–≤–į—ā–Ķ–Ľ—Ć–Ĺ–ĺ—Ā—ā—Ź–ľ–ł –ļ–ĺ–ī–ĺ–≤—č—Ö —Ā–ł–ľ–≤–ĺ–Ľ–ĺ–≤, —ā–ĺ –Ĺ–į–ł–ľ–Ķ–Ĺ—Ć—ą–Ķ–Ķ —Ā—Ä–Ķ–ī–Ĺ–Ķ–Ķ —á–ł—Ā–Ľ–ĺ –ļ–ĺ–ī–ĺ–≤—č—Ö —Ā–ł–ľ–≤–ĺ–Ľ–ĺ–≤ –Ĺ–į –ĺ–ī–ł–Ĺ —Ā–ł–ľ–≤–ĺ–Ľ –ľ–ĺ–∂–Ĺ–ĺ –Ķ—Č—Ď –Ī–ĺ–Ľ–Ķ–Ķ —É–ľ–Ķ–Ĺ—Ć—ą–ł—ā—Ć. –í —ć—ā–ĺ–ľ —Ā–Ľ—É—á–į–Ķ —ā–Ķ–ĺ—Ä–Ķ–ľ–į –ļ–ĺ–ī–ł—Ä–ĺ–≤–į–Ĺ–ł—Ź –≤—č–≥–Ľ—Ź–ī–ł—ā —Ā–Ľ–Ķ–ī—É—é—Č–ł–ľ –ĺ–Ī—Ä–į–∑–ĺ–ľ[9]:

—Ā–ł–ľ–≤–ĺ–Ľ–ĺ–≤ –ł –Ņ—Ä–ĺ–ł–∑–≤–ĺ–ī–ł—ā—Ć –ļ–ĺ–ī–ł—Ä–ĺ–≤–į–Ĺ–ł–Ķ —ć—ā–ł—Ö –≥—Ä—É–Ņ–Ņ –Ņ–ĺ—Ā–Ľ–Ķ–ī–ĺ–≤–į—ā–Ķ–Ľ—Ć–Ĺ–ĺ—Ā—ā—Ź–ľ–ł –ļ–ĺ–ī–ĺ–≤—č—Ö —Ā–ł–ľ–≤–ĺ–Ľ–ĺ–≤, —ā–ĺ –Ĺ–į–ł–ľ–Ķ–Ĺ—Ć—ą–Ķ–Ķ —Ā—Ä–Ķ–ī–Ĺ–Ķ–Ķ —á–ł—Ā–Ľ–ĺ –ļ–ĺ–ī–ĺ–≤—č—Ö —Ā–ł–ľ–≤–ĺ–Ľ–ĺ–≤ –Ĺ–į –ĺ–ī–ł–Ĺ —Ā–ł–ľ–≤–ĺ–Ľ –ľ–ĺ–∂–Ĺ–ĺ –Ķ—Č—Ď –Ī–ĺ–Ľ–Ķ–Ķ —É–ľ–Ķ–Ĺ—Ć—ą–ł—ā—Ć. –í —ć—ā–ĺ–ľ —Ā–Ľ—É—á–į–Ķ —ā–Ķ–ĺ—Ä–Ķ–ľ–į –ļ–ĺ–ī–ł—Ä–ĺ–≤–į–Ĺ–ł—Ź –≤—č–≥–Ľ—Ź–ī–ł—ā —Ā–Ľ–Ķ–ī—É—é—Č–ł–ľ –ĺ–Ī—Ä–į–∑–ĺ–ľ[9]:

–ü—Ä–ł –Ľ—é–Ī–ĺ–ľ –∑–į–ī–į–Ĺ–Ĺ–ĺ–ľ —Ā–ļ–ĺ–Ľ—Ć —É–≥–ĺ–ī–Ĺ–ĺ –ľ–į–Ľ–ĺ–ľ –Ņ–ĺ–Ľ–ĺ–∂–ł—ā–Ķ–Ľ—Ć–Ĺ–ĺ–ľ —á–ł—Ā–Ľ–Ķ  –ľ–ĺ–∂–Ĺ–ĺ –Ĺ–į–Ļ—ā–ł —ā–į–ļ–ĺ–Ķ –Ĺ–į—ā—É—Ä–į–Ľ—Ć–Ĺ–ĺ–Ķ —á–ł—Ā–Ľ–ĺ

–ľ–ĺ–∂–Ĺ–ĺ –Ĺ–į–Ļ—ā–ł —ā–į–ļ–ĺ–Ķ –Ĺ–į—ā—É—Ä–į–Ľ—Ć–Ĺ–ĺ–Ķ —á–ł—Ā–Ľ–ĺ  –ł —Ā–ĺ–ĺ—ā–≤–Ķ—ā—Ā—ā–≤—É—é—Č–Ķ–Ķ –ľ–Ĺ–ĺ–∂–Ķ—Ā—ā–≤–ĺ

–ł —Ā–ĺ–ĺ—ā–≤–Ķ—ā—Ā—ā–≤—É—é—Č–Ķ–Ķ –ľ–Ĺ–ĺ–∂–Ķ—Ā—ā–≤–ĺ  –ļ–ĺ–ī–ĺ–≤—č—Ö —Ā–Ľ–ĺ–≤, —ā–į–ļ–ĺ–Ķ, —á—ā–ĺ —Ā—Ä–Ķ–ī–Ĺ–Ķ–Ķ —á–ł—Ā–Ľ–ĺ —Ā–ł–ľ–≤–ĺ–Ľ–ĺ–≤ –Ĺ–į —Ā–ł–ľ–≤–ĺ–Ľ

–ļ–ĺ–ī–ĺ–≤—č—Ö —Ā–Ľ–ĺ–≤, —ā–į–ļ–ĺ–Ķ, —á—ā–ĺ —Ā—Ä–Ķ–ī–Ĺ–Ķ–Ķ —á–ł—Ā–Ľ–ĺ —Ā–ł–ľ–≤–ĺ–Ľ–ĺ–≤ –Ĺ–į —Ā–ł–ľ–≤–ĺ–Ľ  —É–ī–ĺ–≤–Ľ–Ķ—ā–≤–ĺ—Ä—Ź–Ķ—ā –Ĺ–Ķ—Ä–į–≤–Ķ–Ĺ—Ā—ā–≤—É:

—É–ī–ĺ–≤–Ľ–Ķ—ā–≤–ĺ—Ä—Ź–Ķ—ā –Ĺ–Ķ—Ä–į–≤–Ķ–Ĺ—Ā—ā–≤—É:

–≥–ī–Ķ  ‚ÄĒ —á–ł—Ā–Ľ–ĺ —Ä–į–∑–Ľ–ł—á–Ĺ—č—Ö —Ā–ł–ľ–≤–ĺ–Ľ–ĺ–≤ –ł—Ā—ā–ĺ—á–Ĺ–ł–ļ–į.

‚ÄĒ —á–ł—Ā–Ľ–ĺ —Ä–į–∑–Ľ–ł—á–Ĺ—č—Ö —Ā–ł–ľ–≤–ĺ–Ľ–ĺ–≤ –ł—Ā—ā–ĺ—á–Ĺ–ł–ļ–į.

–≠—ā–ĺ—ā —Ä–Ķ–∑—É–Ľ—Ć—ā–į—ā –ľ–ĺ–∂–Ĺ–ĺ –ī–ĺ—Ā—ā–ł—á—Ć —ā–ĺ–Ľ—Ć–ļ–ĺ –≤ —Ā–Ľ—É—á–į–Ķ, –Ķ—Ā–Ľ–ł —á–ł—Ā–Ľ–ĺ —Ā–ł–ľ–≤–ĺ–Ľ–ĺ–≤ –ł—Ā—ā–ĺ—á–Ĺ–ł–ļ–į  –≤ –ļ–į–∂–ī–ĺ–Ļ –≥—Ä—É–Ņ–Ņ–Ķ —Ā—ā—Ä–Ķ–ľ–ł—ā—Ā—Ź –ļ –Ī–Ķ—Ā–ļ–ĺ–Ĺ–Ķ—á–Ĺ–ĺ—Ā—ā–ł[10].

–≤ –ļ–į–∂–ī–ĺ–Ļ –≥—Ä—É–Ņ–Ņ–Ķ —Ā—ā—Ä–Ķ–ľ–ł—ā—Ā—Ź –ļ –Ī–Ķ—Ā–ļ–ĺ–Ĺ–Ķ—á–Ĺ–ĺ—Ā—ā–ł[10].

–Ę–Ķ–ĺ—Ä–Ķ–ľ–į –ĺ –Ĺ–į–ł–ľ–Ķ–Ĺ—Ć—ą–Ķ–ľ —Ā—Ä–Ķ–ī–Ĺ–Ķ–ľ —á–ł—Ā–Ľ–Ķ –ļ–ĺ–ī–ĺ–≤—č—Ö —Ā–ł–ľ–≤–ĺ–Ľ–ĺ–≤ –Ĺ–į –ĺ–ī–ł–Ĺ —Ā–ł–ľ–≤–ĺ–Ľ –ł—Ā—ā–ĺ—á–Ĺ–ł–ļ–į –Ī—č–Ľ–į —Ā—Ą–ĺ—Ä–ľ—É–Ľ–ł—Ä–ĺ–≤–į–Ĺ–į –ö–Ľ–ĺ–ī–ĺ–ľ –®–Ķ–Ĺ–Ĺ–ĺ–Ĺ–ĺ–ľ –Ņ—Ä–ł –ī–ĺ–ļ–į–∑–į—ā–Ķ–Ľ—Ć—Ā—ā–≤–Ķ —Ā–≤–ĺ–Ķ–Ļ —ā–Ķ–ĺ—Ä–Ķ–ľ—č –ĺ –Ĺ–į–ł–Ī–ĺ–Ľ—Ć—ą–Ķ–Ļ —Ā–ļ–ĺ—Ä–ĺ—Ā—ā–ł –Ņ–Ķ—Ä–Ķ–ī–į—á–ł —Ā–ł–ľ–≤–ĺ–Ľ–ĺ–≤ –ł—Ā—ā–ĺ—á–Ĺ–ł–ļ–į –ī–Ľ—Ź —Ā–Ľ—É—á–į—Ź, –ļ–ĺ–≥–ī–į –ĺ—Ā–Ĺ–ĺ–≤–į–Ĺ–ł–Ķ –ļ–ĺ–ī–ĺ–≤–ĺ–≥–ĺ –į–Ľ—Ą–į–≤–ł—ā–į —Ä–į–≤–Ĺ–ĺ –ī–≤—É–ľ ( )[6].

)[6].

–ě –ľ–į–ļ—Ā–ł–ľ–į–Ľ—Ć–Ĺ–ĺ–Ļ —Ā–ļ–ĺ—Ä–ĺ—Ā—ā–ł –Ņ–Ķ—Ä–Ķ–ī–į—á–ł —Ā–ł–ľ–≤–ĺ–Ľ–ĺ–≤ –ł—Ā—ā–ĺ—á–Ĺ–ł–ļ–į

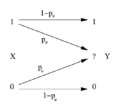

–í —Ā—ā–į—ā—Ć–Ķ –ö–Ľ–ĺ–ī–į –®–Ķ–Ĺ–Ĺ–ĺ–Ĺ–į ¬ę–ú–į—ā–Ķ–ľ–į—ā–ł—á–Ķ—Ā–ļ–į—Ź —ā–Ķ–ĺ—Ä–ł—Ź —Ā–≤—Ź–∑–ł¬Ľ, –ĺ–Ņ—É–Ī–Ľ–ł–ļ–ĺ–≤–į–Ĺ–Ĺ–į—Ź –≤ 1848 –≥–ĺ–ī—É, –ĺ—Ā–Ĺ–ĺ–≤–Ĺ–į—Ź —ā–Ķ–ĺ—Ä–Ķ–ľ–į –ī–Ľ—Ź –ļ–į–Ĺ–į–Ľ–į –Ī–Ķ–∑ —ą—É–ľ–į —Ā—Ą–ĺ—Ä–ľ—É–Ľ–ł—Ä–ĺ–≤–į–Ĺ–į —Ā–Ľ–Ķ–ī—É—é—Č–ł–ľ –ĺ–Ī—Ä–į–∑–ĺ–ľ[4][11]:

–ü—É—Ā—ā—Ć –ł—Ā—ā–ĺ—á–Ĺ–ł–ļ —Ā–ĺ–ĺ–Ī—Č–Ķ–Ĺ–ł–Ļ –ł–ľ–Ķ–Ķ—ā —ć–Ĺ—ā—Ä–ĺ–Ņ–ł—é  (–Ī–ł—ā –Ĺ–į —Ā–ł–ľ–≤–ĺ–Ľ), –į –ļ–į–Ĺ–į–Ľ –ł–ľ–Ķ–Ķ—ā –Ņ—Ä–ĺ–Ņ—É—Ā–ļ–Ĺ—É—é —Ā–Ņ–ĺ—Ā–ĺ–Ī–Ĺ–ĺ—Ā—ā—Ć

(–Ī–ł—ā –Ĺ–į —Ā–ł–ľ–≤–ĺ–Ľ), –į –ļ–į–Ĺ–į–Ľ –ł–ľ–Ķ–Ķ—ā –Ņ—Ä–ĺ–Ņ—É—Ā–ļ–Ĺ—É—é —Ā–Ņ–ĺ—Ā–ĺ–Ī–Ĺ–ĺ—Ā—ā—Ć  (–Ī–ł—ā –≤ —Ā–Ķ–ļ—É–Ĺ–ī—É). –Ę–ĺ–≥–ī–į –ľ–ĺ–∂–Ĺ–ĺ –∑–į–ļ–ĺ–ī–ł—Ä–ĺ–≤–į—ā—Ć —Ā–ĺ–ĺ–Ī—Č–Ķ–Ĺ–ł—Ź (—Ā–ł–ľ–≤–ĺ–Ľ—č) –Ĺ–į –≤—č—Ö–ĺ–ī–Ķ –ł—Ā—ā–ĺ—á–Ĺ–ł–ļ–į —ā–į–ļ–ł–ľ –ĺ–Ī—Ä–į–∑–ĺ–ľ, —á—ā–ĺ–Ī—č –Ņ–Ķ—Ä–Ķ–ī–į–≤–į—ā—Ć –ł—Ö –Ņ–ĺ –ļ–į–Ĺ–į–Ľ—É —Ā–ĺ —Ā—Ä–Ķ–ī–Ĺ–Ķ–Ļ —Ā–ļ–ĺ—Ä–ĺ—Ā—ā—Ć—é

(–Ī–ł—ā –≤ —Ā–Ķ–ļ—É–Ĺ–ī—É). –Ę–ĺ–≥–ī–į –ľ–ĺ–∂–Ĺ–ĺ –∑–į–ļ–ĺ–ī–ł—Ä–ĺ–≤–į—ā—Ć —Ā–ĺ–ĺ–Ī—Č–Ķ–Ĺ–ł—Ź (—Ā–ł–ľ–≤–ĺ–Ľ—č) –Ĺ–į –≤—č—Ö–ĺ–ī–Ķ –ł—Ā—ā–ĺ—á–Ĺ–ł–ļ–į —ā–į–ļ–ł–ľ –ĺ–Ī—Ä–į–∑–ĺ–ľ, —á—ā–ĺ–Ī—č –Ņ–Ķ—Ä–Ķ–ī–į–≤–į—ā—Ć –ł—Ö –Ņ–ĺ –ļ–į–Ĺ–į–Ľ—É —Ā–ĺ —Ā—Ä–Ķ–ī–Ĺ–Ķ–Ļ —Ā–ļ–ĺ—Ä–ĺ—Ā—ā—Ć—é  —Ā–ł–ľ–≤–ĺ–Ľ–ĺ–≤ –≤ –ĺ–ī–Ĺ—É —Ā–Ķ–ļ—É–Ĺ–ī—É, –≥–ī–Ķ

—Ā–ł–ľ–≤–ĺ–Ľ–ĺ–≤ –≤ –ĺ–ī–Ĺ—É —Ā–Ķ–ļ—É–Ĺ–ī—É, –≥–ī–Ķ  ‚ÄĒ —Ā–ļ–ĺ–Ľ—Ć —É–≥–ĺ–ī–Ĺ–ĺ –ľ–į–Ľ–ĺ. –ü–Ķ—Ä–Ķ–ī–į–≤–į—ā—Ć —Ā–ĺ —Ā—Ä–Ķ–ī–Ĺ–Ķ–Ļ —Ā–ļ–ĺ—Ä–ĺ—Ā—ā—Ć—é, –Ī–ĺ–Ľ—Ć—ą–Ķ–Ļ

‚ÄĒ —Ā–ļ–ĺ–Ľ—Ć —É–≥–ĺ–ī–Ĺ–ĺ –ľ–į–Ľ–ĺ. –ü–Ķ—Ä–Ķ–ī–į–≤–į—ā—Ć —Ā–ĺ —Ā—Ä–Ķ–ī–Ĺ–Ķ–Ļ —Ā–ļ–ĺ—Ä–ĺ—Ā—ā—Ć—é, –Ī–ĺ–Ľ—Ć—ą–Ķ–Ļ  , –Ĺ–Ķ–≤–ĺ–∑–ľ–ĺ–∂–Ĺ–ĺ.

, –Ĺ–Ķ–≤–ĺ–∑–ľ–ĺ–∂–Ĺ–ĺ.

–Ē–Ľ—Ź –ł—Ā—ā–ĺ—á–Ĺ–ł–ļ–į, —É –ļ–ĺ—ā–ĺ—Ä–ĺ–≥–ĺ —Ā–ļ–ĺ—Ä–ĺ—Ā—ā—Ć –Ņ–Ķ—Ä–Ķ–ī–į—á–ł —Ā–ł–ľ–≤–ĺ–Ľ–ĺ–≤ –∑–į–ī–į–Ĺ–į, —ć—ā—É —ā–Ķ–ĺ—Ä–Ķ–ľ—É –ľ–ĺ–∂–Ĺ–ĺ —Ā—Ą–ĺ—Ä–ľ—É–Ľ–ł—Ä–ĺ–≤–į—ā—Ć —Ā–Ľ–Ķ–ī—É—é—Č–ł–ľ –ĺ–Ī—Ä–į–∑–ĺ–ľ[5]:

–ü—É—Ā—ā—Ć –ł—Ā—ā–ĺ—á–Ĺ–ł–ļ —Ā–ĺ–ĺ–Ī—Č–Ķ–Ĺ–ł–Ļ –ł–ľ–Ķ–Ķ—ā —ć–Ĺ—ā—Ä–ĺ–Ņ–ł—é  (–Ī–ł—ā –Ĺ–į —Ā–ł–ľ–≤–ĺ–Ľ), –į –ļ–į–Ĺ–į–Ľ –ł–ľ–Ķ–Ķ—ā –Ņ—Ä–ĺ–Ņ—É—Ā–ļ–Ĺ—É—é —Ā–Ņ–ĺ—Ā–ĺ–Ī–Ĺ–ĺ—Ā—ā—Ć

(–Ī–ł—ā –Ĺ–į —Ā–ł–ľ–≤–ĺ–Ľ), –į –ļ–į–Ĺ–į–Ľ –ł–ľ–Ķ–Ķ—ā –Ņ—Ä–ĺ–Ņ—É—Ā–ļ–Ĺ—É—é —Ā–Ņ–ĺ—Ā–ĺ–Ī–Ĺ–ĺ—Ā—ā—Ć  (–Ī–ł—ā –≤ —Ā–Ķ–ļ—É–Ĺ–ī—É). –Ę–ĺ–≥–ī–į –ľ–ĺ–∂–Ĺ–ĺ –∑–į–ļ–ĺ–ī–ł—Ä–ĺ–≤–į—ā—Ć —Ā–ł–ľ–≤–ĺ–Ľ—č –Ĺ–į –≤—č—Ö–ĺ–ī–Ķ –ł—Ā—ā–ĺ—á–Ĺ–ł–ļ–į —ā–į–ļ–ł–ľ –ĺ–Ī—Ä–į–∑–ĺ–ľ, —á—ā–ĺ–Ī—č –Ņ–Ķ—Ä–Ķ–ī–į–≤–į—ā—Ć –ł—Ö —Ā–ļ–ĺ–Ľ—Ć —É–≥–ĺ–ī–Ĺ–ĺ —ā–ĺ—á–Ĺ–ĺ –Ņ–ĺ –ī–ł—Ā–ļ—Ä–Ķ—ā–Ĺ–ĺ–ľ—É –ļ–į–Ĺ–į–Ľ—É –Ī–Ķ–∑ —ą—É–ľ–į –Ņ—Ä–ł —É—Ā–Ľ–ĺ–≤–ł–ł, —á—ā–ĺ

(–Ī–ł—ā –≤ —Ā–Ķ–ļ—É–Ĺ–ī—É). –Ę–ĺ–≥–ī–į –ľ–ĺ–∂–Ĺ–ĺ –∑–į–ļ–ĺ–ī–ł—Ä–ĺ–≤–į—ā—Ć —Ā–ł–ľ–≤–ĺ–Ľ—č –Ĺ–į –≤—č—Ö–ĺ–ī–Ķ –ł—Ā—ā–ĺ—á–Ĺ–ł–ļ–į —ā–į–ļ–ł–ľ –ĺ–Ī—Ä–į–∑–ĺ–ľ, —á—ā–ĺ–Ī—č –Ņ–Ķ—Ä–Ķ–ī–į–≤–į—ā—Ć –ł—Ö —Ā–ļ–ĺ–Ľ—Ć —É–≥–ĺ–ī–Ĺ–ĺ —ā–ĺ—á–Ĺ–ĺ –Ņ–ĺ –ī–ł—Ā–ļ—Ä–Ķ—ā–Ĺ–ĺ–ľ—É –ļ–į–Ĺ–į–Ľ—É –Ī–Ķ–∑ —ą—É–ľ–į –Ņ—Ä–ł —É—Ā–Ľ–ĺ–≤–ł–ł, —á—ā–ĺ  –ł –Ĺ–Ķ–≤–ĺ–∑–ľ–ĺ–∂–Ĺ–ĺ, –Ķ—Ā–Ľ–ł

–ł –Ĺ–Ķ–≤–ĺ–∑–ľ–ĺ–∂–Ĺ–ĺ, –Ķ—Ā–Ľ–ł  ,

,

–≥–ī–Ķ  ‚ÄĒ –Ņ—Ä–ĺ–ł–∑–≤–ĺ–ī–ł—ā–Ķ–Ľ—Ć–Ĺ–ĺ—Ā—ā—Ć –ł—Ā—ā–ĺ—á–Ĺ–ł–ļ–į,

‚ÄĒ –Ņ—Ä–ĺ–ł–∑–≤–ĺ–ī–ł—ā–Ķ–Ľ—Ć–Ĺ–ĺ—Ā—ā—Ć –ł—Ā—ā–ĺ—á–Ĺ–ł–ļ–į,  ‚ÄĒ —Ā—Ä–Ķ–ī–Ĺ—Ź—Ź —Ā–ļ–ĺ—Ä–ĺ—Ā—ā—Ć –Ņ–Ķ—Ä–Ķ–ī–į—á–ł —Ā–ł–ľ–≤–ĺ–Ľ–ĺ–≤ –ł—Ā—ā–ĺ—á–Ĺ–ł–ļ–į.

‚ÄĒ —Ā—Ä–Ķ–ī–Ĺ—Ź—Ź —Ā–ļ–ĺ—Ä–ĺ—Ā—ā—Ć –Ņ–Ķ—Ä–Ķ–ī–į—á–ł —Ā–ł–ľ–≤–ĺ–Ľ–ĺ–≤ –ł—Ā—ā–ĺ—á–Ĺ–ł–ļ–į.

–Ē–ĺ–ļ–į–∑–į—ā–Ķ–Ľ—Ć—Ā—ā–≤–ĺ

–Ę–Ķ–ĺ—Ä–Ķ–ľ–į –ĺ —Ā—Ä–Ķ–ī–Ĺ–Ķ–ľ —á–ł—Ā–Ľ–Ķ –ļ–ĺ–ī–ĺ–≤—č—Ö —Ā–ł–ľ–≤–ĺ–Ľ–ĺ–≤ –Ĺ–į —Ā–ł–ľ–≤–ĺ–Ľ –ł—Ā—ā–ĺ—á–Ĺ–ł–ļ–į

–°–Ĺ–į—á–į–Ľ–į –ī–ĺ–ļ–į–∂–Ķ–ľ —Ā–Ľ–Ķ–ī—É—é—Č–Ķ–Ķ –Ĺ–Ķ—Ä–į–≤–Ķ–Ĺ—Ā—ā–≤–ĺ –ī–Ľ—Ź —Ā–Ľ—É—á–į—Ź, –ļ–ĺ–≥–ī–į —Ā–ł–ľ–≤–ĺ–Ľ—č –ł—Ā—ā–ĺ—á–Ĺ–ł–ļ–į –ļ–ĺ–ī–ł—Ä—É—é—ā—Ā—Ź –Ņ–ĺ –ĺ—ā–ī–Ķ–Ľ—Ć–Ĺ–ĺ—Ā—ā–ł:

–≥–ī–Ķ  ‚ÄĒ —ć–Ĺ—ā—Ä–ĺ–Ņ–ł—Ź –ł—Ā—ā–ĺ—á–Ĺ–ł–ļ–į,

‚ÄĒ —ć–Ĺ—ā—Ä–ĺ–Ņ–ł—Ź –ł—Ā—ā–ĺ—á–Ĺ–ł–ļ–į,  ‚ÄĒ –ĺ—Ā–Ĺ–ĺ–≤–į–Ĺ–ł–Ķ –ļ–ĺ–ī–ĺ–≤–ĺ–≥–ĺ –į–Ľ—Ą–į–≤–ł—ā–į, —ā–ĺ –Ķ—Ā—ā—Ć —á–ł—Ā–Ľ–ĺ —Ä–į–∑–Ľ–ł—á–Ĺ—č—Ö —Ā–ł–ľ–≤–ĺ–Ľ–ĺ–≤ –ļ–ĺ–ī–į,

‚ÄĒ –ĺ—Ā–Ĺ–ĺ–≤–į–Ĺ–ł–Ķ –ļ–ĺ–ī–ĺ–≤–ĺ–≥–ĺ –į–Ľ—Ą–į–≤–ł—ā–į, —ā–ĺ –Ķ—Ā—ā—Ć —á–ł—Ā–Ľ–ĺ —Ä–į–∑–Ľ–ł—á–Ĺ—č—Ö —Ā–ł–ľ–≤–ĺ–Ľ–ĺ–≤ –ļ–ĺ–ī–į,  ‚ÄĒ —Ā—Ä–Ķ–ī–Ĺ–Ķ–Ķ —á–ł—Ā–Ľ–ĺ –ļ–ĺ–ī–ĺ–≤—č—Ö —Ā–ł–ľ–≤–ĺ–Ľ–ĺ–≤ –Ĺ–į —Ā–ł–ľ–≤–ĺ–Ľ –ł—Ā—ā–ĺ—á–Ĺ–ł–ļ–į.

‚ÄĒ —Ā—Ä–Ķ–ī–Ĺ–Ķ–Ķ —á–ł—Ā–Ľ–ĺ –ļ–ĺ–ī–ĺ–≤—č—Ö —Ā–ł–ľ–≤–ĺ–Ľ–ĺ–≤ –Ĺ–į —Ā–ł–ľ–≤–ĺ–Ľ –ł—Ā—ā–ĺ—á–Ĺ–ł–ļ–į.

C—Ä–Ķ–ī–Ĺ–Ķ–Ķ —á–ł—Ā–Ľ–ĺ –ļ–ĺ–ī–ĺ–≤—č—Ö —Ā–ł–ľ–≤–ĺ–Ľ–ĺ–≤ –Ĺ–į –ĺ–ī–Ĺ–ĺ —Ā–ł–ľ–≤–ĺ–Ľ –ł—Ā—ā–ĺ—á–Ĺ–ł–ļ–į –ĺ–Ņ—Ä–Ķ–ī–Ķ–Ľ—Ź–Ķ—ā—Ā—Ź –Ņ–ĺ —Ą–ĺ—Ä–ľ—É–Ľ–Ķ[12]:

–≥–ī–Ķ  ‚ÄĒ –ĺ—Ā–Ĺ–ĺ–≤–į–Ĺ–ł–Ķ –į–Ľ—Ą–į–≤–ł—ā–į –ł—Ā—ā–ĺ—á–Ĺ–ł–ļ–į (—á–ł—Ā–Ľ–ĺ —Ä–į–∑–Ľ–ł—á–Ĺ—č—Ö —Ā–ł–ľ–≤–ĺ–Ľ–ĺ–≤ –ł—Ā—ā–ĺ—á–Ĺ–ł–ļ–į),

‚ÄĒ –ĺ—Ā–Ĺ–ĺ–≤–į–Ĺ–ł–Ķ –į–Ľ—Ą–į–≤–ł—ā–į –ł—Ā—ā–ĺ—á–Ĺ–ł–ļ–į (—á–ł—Ā–Ľ–ĺ —Ä–į–∑–Ľ–ł—á–Ĺ—č—Ö —Ā–ł–ľ–≤–ĺ–Ľ–ĺ–≤ –ł—Ā—ā–ĺ—á–Ĺ–ł–ļ–į),  ‚ÄĒ –≤–Ķ—Ä–ĺ—Ź—ā–Ĺ–ĺ—Ā—ā—Ć –Ņ–Ķ—Ä–Ķ–ī–į—á–ł

‚ÄĒ –≤–Ķ—Ä–ĺ—Ź—ā–Ĺ–ĺ—Ā—ā—Ć –Ņ–Ķ—Ä–Ķ–ī–į—á–ł  -–≥–ĺ —Ā–ł–ľ–≤–ĺ–Ľ–į –ł—Ā—ā–ĺ—á–Ĺ–ł–ļ–į,

-–≥–ĺ —Ā–ł–ľ–≤–ĺ–Ľ–į –ł—Ā—ā–ĺ—á–Ĺ–ł–ļ–į,  ‚ÄĒ —á–ł—Ā–Ľ–ĺ –ļ–ĺ–ī–ĺ–≤—č—Ö —Ā–ł–ľ–≤–ĺ–Ľ–ĺ–≤, –Ņ—Ä–ł—Ö–ĺ–ī—Ź—Č–ł—Ö—Ā—Ź –Ĺ–į

‚ÄĒ —á–ł—Ā–Ľ–ĺ –ļ–ĺ–ī–ĺ–≤—č—Ö —Ā–ł–ľ–≤–ĺ–Ľ–ĺ–≤, –Ņ—Ä–ł—Ö–ĺ–ī—Ź—Č–ł—Ö—Ā—Ź –Ĺ–į  -—č–Ļ —Ā–ł–ľ–≤–ĺ–Ľ –ł—Ā—ā–ĺ—á–Ĺ–ł–ļ–į.

-—č–Ļ —Ā–ł–ľ–≤–ĺ–Ľ –ł—Ā—ā–ĺ—á–Ĺ–ł–ļ–į.

–í–Ķ–Ľ–ł—á–ł–Ĺ—É  –ľ–ĺ–∂–Ĺ–ĺ –Ņ—Ä–Ķ–ī—Ā—ā–į–≤–ł—ā—Ć –≤ –≤–ł–ī–Ķ[13]:

–ľ–ĺ–∂–Ĺ–ĺ –Ņ—Ä–Ķ–ī—Ā—ā–į–≤–ł—ā—Ć –≤ –≤–ł–ī–Ķ[13]:

–≥–ī–Ķ

,

,

–ė—Ā–Ņ–ĺ–Ľ—Ć–∑—É—Ź –Ĺ–Ķ—Ä–į–≤–Ķ–Ĺ—Ā—ā–≤–ĺ –ď–ł–Ī–Ī—Ā–į[–į–Ĺ–≥–Ľ.]:

–ł –Ĺ–Ķ—Ä–į–≤–Ķ–Ĺ—Ā—ā–≤–ĺ –ö—Ä–į—Ą—ā–į

–Ņ–ĺ–Ľ—É—á–į–Ķ–ľ[12]:

–†–į–≤–Ķ–Ĺ—Ā—ā–≤–ĺ –ī–ĺ—Ā—ā–ł–≥–į–Ķ—ā—Ā—Ź —ā–ĺ–Ľ—Ć–ļ–ĺ –ī–Ľ—Ź —Ā–Ľ—É—á–į—Ź, –ļ–ĺ–≥–ī–į  –ł

–ł  [12].

[12].

–ü–Ķ—Ä–Ķ–≤–Ķ–ī—Ď–ľ –ī–Ľ–ł–Ĺ—č –ļ–ĺ–ī–ĺ–≤ –≤ —Ü–Ķ–Ľ—č–Ķ —á–ł—Ā–Ľ–į, —Ā –Ņ–ĺ–ľ–ĺ—Č—Ć—é –ĺ–ļ—Ä—É–≥–Ľ–Ķ–Ĺ–ł—Ź –≤–≤–Ķ—Ä—Ö[14]:

,

,

–≥–ī–Ķ  –ĺ–Ī–ĺ–∑–Ĺ–į—á–į–Ķ—ā –Ĺ–į–ł–ľ–Ķ–Ĺ—Ć—ą–Ķ–Ķ —Ü–Ķ–Ľ–ĺ–Ķ —á–ł—Ā–Ľ–ĺ, –Ī–ĺ–Ľ—Ć—ą–Ķ–Ķ –ł–Ľ–ł —Ä–į–≤–Ĺ–ĺ–Ķ

–ĺ–Ī–ĺ–∑–Ĺ–į—á–į–Ķ—ā –Ĺ–į–ł–ľ–Ķ–Ĺ—Ć—ą–Ķ–Ķ —Ü–Ķ–Ľ–ĺ–Ķ —á–ł—Ā–Ľ–ĺ, –Ī–ĺ–Ľ—Ć—ą–Ķ–Ķ –ł–Ľ–ł —Ä–į–≤–Ĺ–ĺ–Ķ  .

.

–ú–ĺ–∂–Ĺ–ĺ –Ņ—Ä–ĺ–≤–Ķ—Ä–ł—ā—Ć, —á—ā–ĺ —Ā—É—Č–Ķ—Ā—ā–≤—É–Ķ—ā –Ņ—Ä–Ķ—Ą–ł–ļ—Ā–Ĺ—č–Ļ –ļ–ĺ–ī —Ā —ā–į–ļ–ł–ľ–ł –ī–Ľ–ł–Ĺ–į–ľ–ł, —ā–į–ļ –ļ–į–ļ –Ĺ–Ķ—Ä–į–≤–Ķ–Ĺ—Ā—ā–≤–ĺ –ö—Ä–į—Ą—ā–į –ī–Ľ—Ź –Ĺ–Ķ–≥–ĺ –≤—č–Ņ–ĺ–Ľ–Ĺ—Ź–Ķ—ā—Ā—Ź[14]:

.

.

–ó–į—ā–Ķ–ľ –ľ–ĺ–∂–Ĺ–ĺ –ī–ĺ–ļ–į–∑–į—ā—Ć, —á—ā–ĺ[14][15]

.

.

–Ę–į–ļ–ł–ľ –ĺ–Ī—Ä–į–∑–ĺ–ľ, –Ņ–ĺ–Ľ—É—á–į–Ķ–ľ –≤—č–Ņ–ĺ–Ľ–Ĺ–Ķ–Ĺ–ł–Ķ –Ĺ–Ķ—Ä–į–≤–Ķ–Ĺ—Ā—ā–≤–į:

–ē—Ā–Ľ–ł –ĺ–Ī—ä–Ķ–ī–ł–Ĺ—Ź—ā—Ć —Ā–ł–ľ–≤–ĺ–Ľ—č –ł—Ā—ā–ĺ—á–Ĺ–ł–ļ–į –≤ –≥—Ä—É–Ņ–Ņ—č –Ņ–ĺ  —Ā–ł–ľ–≤–ĺ–Ľ–ĺ–≤ –ł –Ņ—Ä–ĺ–ł–∑–≤–ĺ–ī–ł—ā—Ć –ļ–ĺ–ī–ł—Ä–ĺ–≤–į–Ĺ–ł–Ķ —ć—ā–ł—Ö –≥—Ä—É–Ņ–Ņ –Ņ–ĺ—Ā–Ľ–Ķ–ī–ĺ–≤–į—ā–Ķ–Ľ—Ć–Ĺ–ĺ—Ā—ā—Ź–ľ–ł –ļ–ĺ–ī–ĺ–≤—č—Ö —Ā–ł–ľ–≤–ĺ–Ľ–ĺ–≤, —ā–ĺ —Ā—Ä–Ķ–ī–Ĺ–Ķ–Ķ —á–ł—Ā–Ľ–ĺ –ļ–ĺ–ī–ĺ–≤—č—Ö —Ā–ł–ľ–≤–ĺ–Ľ–ĺ–≤, –Ņ—Ä–ł—Ö–ĺ–ī—Ź—Č–ł—Ö—Ā—Ź –Ĺ–į –ĺ–ī–ł–Ĺ —Ā–ł–ľ–≤–ĺ–Ľ –ł—Ā—ā–ĺ—á–Ĺ–ł–ļ–į —Ä–į–≤–Ĺ–ĺ[9][16]:

—Ā–ł–ľ–≤–ĺ–Ľ–ĺ–≤ –ł –Ņ—Ä–ĺ–ł–∑–≤–ĺ–ī–ł—ā—Ć –ļ–ĺ–ī–ł—Ä–ĺ–≤–į–Ĺ–ł–Ķ —ć—ā–ł—Ö –≥—Ä—É–Ņ–Ņ –Ņ–ĺ—Ā–Ľ–Ķ–ī–ĺ–≤–į—ā–Ķ–Ľ—Ć–Ĺ–ĺ—Ā—ā—Ź–ľ–ł –ļ–ĺ–ī–ĺ–≤—č—Ö —Ā–ł–ľ–≤–ĺ–Ľ–ĺ–≤, —ā–ĺ —Ā—Ä–Ķ–ī–Ĺ–Ķ–Ķ —á–ł—Ā–Ľ–ĺ –ļ–ĺ–ī–ĺ–≤—č—Ö —Ā–ł–ľ–≤–ĺ–Ľ–ĺ–≤, –Ņ—Ä–ł—Ö–ĺ–ī—Ź—Č–ł—Ö—Ā—Ź –Ĺ–į –ĺ–ī–ł–Ĺ —Ā–ł–ľ–≤–ĺ–Ľ –ł—Ā—ā–ĺ—á–Ĺ–ł–ļ–į —Ä–į–≤–Ĺ–ĺ[9][16]:

–≥–ī–Ķ  ‚ÄĒ –≤–Ķ—Ä–ĺ—Ź—ā–Ĺ–ĺ—Ā—ā—Ć –Ņ–Ķ—Ä–Ķ–ī–į—á–ł

‚ÄĒ –≤–Ķ—Ä–ĺ—Ź—ā–Ĺ–ĺ—Ā—ā—Ć –Ņ–Ķ—Ä–Ķ–ī–į—á–ł  -–ĺ–Ļ –≥—Ä—É–Ņ–Ņ—č,

-–ĺ–Ļ –≥—Ä—É–Ņ–Ņ—č,  ‚ÄĒ —á–ł—Ā–Ľ–ĺ –ļ–ĺ–ī–ĺ–≤—č—Ö —Ā–ł–ľ–≤–ĺ–Ľ–ĺ–≤, –Ņ—Ä–ł—Ö–ĺ–ī—Ź—Č–ł—Ö—Ā—Ź –Ĺ–į

‚ÄĒ —á–ł—Ā–Ľ–ĺ –ļ–ĺ–ī–ĺ–≤—č—Ö —Ā–ł–ľ–≤–ĺ–Ľ–ĺ–≤, –Ņ—Ä–ł—Ö–ĺ–ī—Ź—Č–ł—Ö—Ā—Ź –Ĺ–į  -—É—é –≥—Ä—É–Ņ–Ņ—É,

-—É—é –≥—Ä—É–Ņ–Ņ—É,  ‚ÄĒ —Ā—Ä–Ķ–ī–Ĺ–Ķ–Ķ —á–ł—Ā–Ľ–ĺ –ļ–ĺ–ī–ĺ–≤—č—Ö —Ā–ł–ľ–≤–ĺ–Ľ–ĺ–≤ –Ĺ–į –ĺ–ī–Ĺ—É –≥—Ä—É–Ņ–Ņ—É.

‚ÄĒ —Ā—Ä–Ķ–ī–Ĺ–Ķ–Ķ —á–ł—Ā–Ľ–ĺ –ļ–ĺ–ī–ĺ–≤—č—Ö —Ā–ł–ľ–≤–ĺ–Ľ–ĺ–≤ –Ĺ–į –ĺ–ī–Ĺ—É –≥—Ä—É–Ņ–Ņ—É.

–Ę–ĺ–≥–ī–į, –Ņ–ĺ–ī—Ā—ā–į–≤–Ľ—Ź—Ź –≤ –Ņ–ĺ–Ľ—É—á–Ķ–Ĺ–Ĺ–ĺ–Ķ –Ĺ–Ķ—Ä–į–≤–Ķ–Ĺ—Ā—ā–≤–ĺ –ī–Ľ—Ź —Ā—Ä–Ķ–ī–Ĺ–Ķ–≥–ĺ —á–ł—Ā–Ľ–į –ļ–ĺ–ī–ĺ–≤—č—Ö —Ā–ł–ľ–≤–ĺ–Ľ–ĺ–≤ –Ĺ–į –ĺ–ī–ł–Ĺ —Ā–ł–ľ–≤–ĺ–Ľ –≤–ľ–Ķ—Ā—ā–ĺ  –≤–Ķ–Ľ–ł—á–ł–Ĺ—É

–≤–Ķ–Ľ–ł—á–ł–Ĺ—É  –ł –≤–ľ–Ķ—Ā—ā–ĺ —ć–Ĺ—ā—Ä–ĺ–Ņ–ł–ł –Ĺ–į –ĺ–ī–ł–Ĺ —Ā–ł–ľ–≤–ĺ–Ľ –ł—Ā—ā–ĺ—á–Ĺ–ł–ļ–į

–ł –≤–ľ–Ķ—Ā—ā–ĺ —ć–Ĺ—ā—Ä–ĺ–Ņ–ł–ł –Ĺ–į –ĺ–ī–ł–Ĺ —Ā–ł–ľ–≤–ĺ–Ľ –ł—Ā—ā–ĺ—á–Ĺ–ł–ļ–į  —ć–Ĺ—ā—Ä–ĺ–Ņ–ł—é –≥—Ä—É–Ņ–Ņ—č —Ā–ł–ľ–≤–ĺ–Ľ–ĺ–≤

—ć–Ĺ—ā—Ä–ĺ–Ņ–ł—é –≥—Ä—É–Ņ–Ņ—č —Ā–ł–ľ–≤–ĺ–Ľ–ĺ–≤  , –į –∑–į—ā–Ķ–ľ —Ä–į–∑–ī–Ķ–Ľ–ł–≤ –Ĺ–į

, –į –∑–į—ā–Ķ–ľ —Ä–į–∑–ī–Ķ–Ľ–ł–≤ –Ĺ–į  , –Ņ–ĺ–Ľ—É—á–į–Ķ–ľ:

, –Ņ–ĺ–Ľ—É—á–į–Ķ–ľ:

–í–Ķ–Ľ–ł—á–ł–Ĺ—č  —Ä–į–≤–Ĺ—č —ć–Ĺ—ā—Ä–ĺ–Ņ–ł–ł –ł—Ā—ā–ĺ—á–Ĺ–ł–ļ–į

—Ä–į–≤–Ĺ—č —ć–Ĺ—ā—Ä–ĺ–Ņ–ł–ł –ł—Ā—ā–ĺ—á–Ĺ–ł–ļ–į  [17], –Ņ–ĺ—ć—ā–ĺ–ľ—É –Ņ—Ä–ł

[17], –Ņ–ĺ—ć—ā–ĺ–ľ—É –Ņ—Ä–ł  –Ņ–ĺ–Ľ—É—á–į–Ķ–ľ[6]:

–Ņ–ĺ–Ľ—É—á–į–Ķ–ľ[6]:

–≥–ī–Ķ  ‚ÄĒ —Ā–ļ–ĺ–Ľ—Ć —É–≥–ĺ–ī–Ĺ–ĺ –ľ–į–Ľ–ĺ.

‚ÄĒ —Ā–ļ–ĺ–Ľ—Ć —É–≥–ĺ–ī–Ĺ–ĺ –ľ–į–Ľ–ĺ.

–Ę–į–ļ–ł–ľ –ĺ–Ī—Ä–į–∑–ĺ–ľ, –Ņ—Ä–ł —Ā—ā—Ä–Ķ–ľ–Ľ–Ķ–Ĺ–ł–ł –ī–Ľ–ł–Ĺ—č –ļ–ĺ–ī–ł—Ä—É–Ķ–ľ–ĺ–Ļ –≥—Ä—É–Ņ–Ņ—č —Ā–ł–ľ–≤–ĺ–Ľ–ĺ–≤ –ļ –Ī–Ķ—Ā–ļ–ĺ–Ĺ–Ķ—á–Ĺ–ĺ—Ā—ā–ł —Ā—Ä–Ķ–ī–Ĺ–Ķ–Ķ —á–ł—Ā–Ľ–ĺ –ļ–ĺ–ī–ĺ–≤—č—Ö —Ā–ł–ľ–≤–ĺ–Ľ–ĺ–≤, –Ņ—Ä–ł—Ö–ĺ–ī—Ź—Č–ł—Ö—Ā—Ź –Ĺ–į –ĺ–ī–ł–Ĺ —Ā–ł–ľ–≤–ĺ–Ľ –ł—Ā—ā–ĺ—á–Ĺ–ł–ļ–į —Ā—ā—Ä–Ķ–ľ–ł—ā—Ā—Ź –ļ  .

.

–Ę–Ķ–ĺ—Ä–Ķ–ľ–į –ĺ –ľ–į–ļ—Ā–ł–ľ–į–Ľ—Ć–Ĺ–ĺ–Ļ —Ā–ļ–ĺ—Ä–ĺ—Ā—ā–ł –Ņ–Ķ—Ä–Ķ–ī–į—á–ł —Ā–ł–ľ–≤–ĺ–Ľ–ĺ–≤ –ł—Ā—ā–ĺ—á–Ĺ–ł–ļ–į

–Ē–ĺ–ļ–į–∂–Ķ–ľ –Ņ—Ä—Ź–ľ—É—é —á–į—Ā—ā—Ć —ā–Ķ–ĺ—Ä–Ķ–ľ—č, –Ņ–ĺ–ļ–į–∑—č–≤–į—é—Č—É—é, —á—ā–ĺ –ľ–ĺ–∂–Ĺ–ĺ –∑–į–ļ–ĺ–ī–ł—Ä–ĺ–≤–į—ā—Ć —Ā–ł–ľ–≤–ĺ–Ľ—č –Ĺ–į –≤—č—Ö–ĺ–ī–Ķ –ł—Ā—ā–ĺ—á–Ĺ–ł–ļ–į —ā–į–ļ–ł–ľ –ĺ–Ī—Ä–į–∑–ĺ–ľ, —á—ā–ĺ–Ī—č –Ņ–Ķ—Ä–Ķ–ī–į–≤–į—ā—Ć –ł—Ö –Ņ–ĺ –ļ–į–Ĺ–į–Ľ—É —Ā–ĺ —Ā—Ä–Ķ–ī–Ĺ–Ķ–Ļ —Ā–ļ–ĺ—Ä–ĺ—Ā—ā—Ć—é  —Ā–ł–ľ–≤–ĺ–Ľ–ĺ–≤ –≤ —Ā–Ķ–ļ—É–Ĺ–ī—É, –≥–ī–Ķ

—Ā–ł–ľ–≤–ĺ–Ľ–ĺ–≤ –≤ —Ā–Ķ–ļ—É–Ĺ–ī—É, –≥–ī–Ķ  ‚ÄĒ —Ā–ļ–ĺ–Ľ—Ć —É–≥–ĺ–ī–Ĺ–ĺ –ľ–į–Ľ–ĺ.

‚ÄĒ —Ā–ļ–ĺ–Ľ—Ć —É–≥–ĺ–ī–Ĺ–ĺ –ľ–į–Ľ–ĺ.

–ü—Ä–ĺ–Ņ—É—Ā–ļ–Ĺ–į—Ź —Ā–Ņ–ĺ—Ā–ĺ–Ī–Ĺ–ĺ—Ā—ā—Ć –ļ–į–Ĺ–į–Ľ–į —Ā–≤—Ź–∑–ł –Ī–Ķ–∑ —ą—É–ľ–į (–ľ–Ķ–∂–ī—É –≤—č—Ö–ĺ–ī–ĺ–ľ –ļ–ĺ–ī–Ķ—Ä–į –ł—Ā—ā–ĺ—á–Ĺ–ł–ļ–į –ł –≤—Ö–ĺ–ī–ĺ–ľ –ī–Ķ–ļ–ĺ–ī–Ķ—Ä–į –ł—Ā—ā–ĺ—á–Ĺ–ł–ļ–į) —Ä–į–≤–Ĺ–į:

–≥–ī–Ķ

‚ÄĒ —ć–Ĺ—ā—Ä–ĺ–Ņ–ł—Ź –ļ–ĺ–ī–ĺ–≤—č—Ö —Ā–ł–ľ–≤–ĺ–Ľ–ĺ–≤

‚ÄĒ —ć–Ĺ—ā—Ä–ĺ–Ņ–ł—Ź –ļ–ĺ–ī–ĺ–≤—č—Ö —Ā–ł–ľ–≤–ĺ–Ľ–ĺ–≤  ,

,  ,

, ‚ÄĒ –≤—Ä–Ķ–ľ—Ź, –∑–į—ā—Ä–į—á–ł–≤–į–Ķ–ľ–ĺ–Ķ –Ĺ–į –Ņ–Ķ—Ä–Ķ–ī–į—á—É –ĺ–ī–Ĺ–ĺ–≥–ĺ –ļ–ĺ–ī–ĺ–≤–ĺ–≥–ĺ —Ā–ł–ľ–≤–ĺ–Ľ–į, –ļ–ĺ—ā–ĺ—Ä–ĺ–Ķ —Ä–į–≤–Ĺ–ĺ

‚ÄĒ –≤—Ä–Ķ–ľ—Ź, –∑–į—ā—Ä–į—á–ł–≤–į–Ķ–ľ–ĺ–Ķ –Ĺ–į –Ņ–Ķ—Ä–Ķ–ī–į—á—É –ĺ–ī–Ĺ–ĺ–≥–ĺ –ļ–ĺ–ī–ĺ–≤–ĺ–≥–ĺ —Ā–ł–ľ–≤–ĺ–Ľ–į, –ļ–ĺ—ā–ĺ—Ä–ĺ–Ķ —Ä–į–≤–Ĺ–ĺ  , –≥–ī–Ķ

, –≥–ī–Ķ  ‚ÄĒ —Ā—Ä–Ķ–ī–Ĺ–Ķ–Ķ –≤—Ä–Ķ–ľ—Ź, –∑–į—ā—Ä–į—á–ł–≤–į–Ķ–ľ–ĺ–Ķ –Ĺ–į –Ņ–Ķ—Ä–Ķ–ī–į—á—É –ĺ–ī–Ĺ–ĺ–≥–ĺ —Ā–ł–ľ–≤–ĺ–Ľ–į –ł—Ā—ā–ĺ—á–Ĺ–ł–ļ–į,

‚ÄĒ —Ā—Ä–Ķ–ī–Ĺ–Ķ–Ķ –≤—Ä–Ķ–ľ—Ź, –∑–į—ā—Ä–į—á–ł–≤–į–Ķ–ľ–ĺ–Ķ –Ĺ–į –Ņ–Ķ—Ä–Ķ–ī–į—á—É –ĺ–ī–Ĺ–ĺ–≥–ĺ —Ā–ł–ľ–≤–ĺ–Ľ–į –ł—Ā—ā–ĺ—á–Ĺ–ł–ļ–į,  ‚ÄĒ —Ā—Ä–Ķ–ī–Ĺ—Ź—Ź —Ā–ļ–ĺ—Ä–ĺ—Ā—ā—Ć –Ņ–Ķ—Ä–Ķ–ī–į—á–ł —Ā–ł–ľ–≤–ĺ–Ľ–ĺ–≤ –ł—Ā—ā–ĺ—á–Ĺ–ł–ļ–į. –Ę–į–ļ –ļ–į–ļ

‚ÄĒ —Ā—Ä–Ķ–ī–Ĺ—Ź—Ź —Ā–ļ–ĺ—Ä–ĺ—Ā—ā—Ć –Ņ–Ķ—Ä–Ķ–ī–į—á–ł —Ā–ł–ľ–≤–ĺ–Ľ–ĺ–≤ –ł—Ā—ā–ĺ—á–Ĺ–ł–ļ–į. –Ę–į–ļ –ļ–į–ļ  –Ņ–ĺ–Ľ—É—á–į–Ķ–ľ:

–Ņ–ĺ–Ľ—É—á–į–Ķ–ľ:

, —ā–ĺ –Ķ—Ā—ā—Ć

, —ā–ĺ –Ķ—Ā—ā—Ć  .

.

–Ę–į–ļ–ł–ľ –ĺ–Ī—Ä–į–∑–ĺ–ľ, –≤—č–Ņ–ĺ–Ľ–Ĺ–ł–≤ –ļ–ĺ–ī–ł—Ä–ĺ–≤–į–Ĺ–ł–Ķ —Ā–ł–ľ–≤–ĺ–Ľ–ĺ–≤ –ł—Ā—ā–ĺ—á–Ĺ–ł–ļ–į —Ā –ľ–ł–Ĺ–ł–ľ–į–Ľ—Ć–Ĺ—č–ľ —á–ł—Ā–Ľ–ĺ–ľ –ļ–ĺ–ī–ĺ–≤—č—Ö —Ā–ł–ľ–≤–ĺ–Ľ–ĺ–≤ –Ĺ–į —Ā–ł–ľ–≤–ĺ–Ľ, –ľ–ĺ–∂–Ĺ–ĺ –Ņ–Ķ—Ä–Ķ–ī–į–≤–į—ā—Ć —Ā–ł–ľ–≤–ĺ–Ľ—č —Ā–ĺ —Ā—Ä–Ķ–ī–Ĺ–Ķ–Ļ —Ā–ļ–ĺ—Ä–ĺ—Ā—ā—Ć—é  —Ā–ł–ľ–≤–ĺ–Ľ–ĺ–≤ –≤ —Ā–Ķ–ļ—É–Ĺ–ī—É.

—Ā–ł–ľ–≤–ĺ–Ľ–ĺ–≤ –≤ —Ā–Ķ–ļ—É–Ĺ–ī—É.

–ě–Ī—Ä–į—ā–Ĺ–į—Ź —á–į—Ā—ā—Ć —ā–Ķ–ĺ—Ä–Ķ–ľ—č, —É—ā–≤–Ķ—Ä–∂–ī–į—é—Č–į—Ź, —á—ā–ĺ —Ā—Ä–Ķ–ī–Ĺ—Ź—Ź —Ā–ļ–ĺ—Ä–ĺ—Ā—ā—Ć –Ņ–Ķ—Ä–Ķ–ī–į—á–ł —Ā–ł–ľ–≤–ĺ–Ľ–ĺ–≤ –ł—Ā—ā–ĺ—á–Ĺ–ł–ļ–į  –Ĺ–Ķ –ľ–ĺ–∂–Ķ—ā –Ņ—Ä–Ķ–≤–∑–ĺ–Ļ—ā–ł –∑–Ĺ–į—á–Ķ–Ĺ–ł–Ķ

–Ĺ–Ķ –ľ–ĺ–∂–Ķ—ā –Ņ—Ä–Ķ–≤–∑–ĺ–Ļ—ā–ł –∑–Ĺ–į—á–Ķ–Ĺ–ł–Ķ  , –ī–ĺ–ļ–į–∑—č–≤–į–Ķ—ā—Ā—Ź —ā–Ķ–ľ, —á—ā–ĺ –Ņ—Ä–ĺ–Ņ—É—Ā–ļ–Ĺ–į—Ź —Ā–Ņ–ĺ—Ā–ĺ–Ī–Ĺ–ĺ—Ā—ā—Ć –ļ–į–Ĺ–į–Ľ–į ‚ÄĒ —ć—ā–ĺ –ľ–į–ļ—Ā–ł–ľ–į–Ľ—Ć–Ĺ–į—Ź —Ā–ļ–ĺ—Ä–ĺ—Ā—ā—Ć –Ņ–Ķ—Ä–Ķ–ī–į—á–ł –ł–Ĺ—Ą–ĺ—Ä–ľ–į—Ü–ł–ł –Ņ–ĺ –ļ–į–Ĺ–į–Ľ—É —Ā–≤—Ź–∑–ł.

, –ī–ĺ–ļ–į–∑—č–≤–į–Ķ—ā—Ā—Ź —ā–Ķ–ľ, —á—ā–ĺ –Ņ—Ä–ĺ–Ņ—É—Ā–ļ–Ĺ–į—Ź —Ā–Ņ–ĺ—Ā–ĺ–Ī–Ĺ–ĺ—Ā—ā—Ć –ļ–į–Ĺ–į–Ľ–į ‚ÄĒ —ć—ā–ĺ –ľ–į–ļ—Ā–ł–ľ–į–Ľ—Ć–Ĺ–į—Ź —Ā–ļ–ĺ—Ä–ĺ—Ā—ā—Ć –Ņ–Ķ—Ä–Ķ–ī–į—á–ł –ł–Ĺ—Ą–ĺ—Ä–ľ–į—Ü–ł–ł –Ņ–ĺ –ļ–į–Ĺ–į–Ľ—É —Ā–≤—Ź–∑–ł.

–Ę–į–ļ –ļ–į–ļ  –ł

–ł  –ī–Ľ—Ź –Ľ—é–Ī–ĺ–≥–ĺ –ļ–ĺ–ī–į, —ā–ĺ –Ņ–ĺ–Ľ—É—á–į–Ķ–ľ:

–ī–Ľ—Ź –Ľ—é–Ī–ĺ–≥–ĺ –ļ–ĺ–ī–į, —ā–ĺ –Ņ–ĺ–Ľ—É—á–į–Ķ–ľ:

.

.

–°–Ľ–Ķ–ī–ĺ–≤–į—ā–Ķ–Ľ—Ć–Ĺ–ĺ, –ī–Ľ—Ź –Ľ—é–Ī–ĺ–≥–ĺ –ļ–ĺ–ī–į –ī–ĺ–Ľ–∂–Ĺ–ĺ –≤—č–Ņ–ĺ–Ľ–Ĺ—Ź—ā—Ć—Ā—Ź –Ĺ–Ķ—Ä–į–≤–Ķ–Ĺ—Ā—ā–≤–ĺ:  . –ü–ĺ—ć—ā–ĺ–ľ—É –Ņ–Ķ—Ä–Ķ–ī–į–≤–į—ā—Ć —Ā–ł–ľ–≤–ĺ–Ľ—č –ł—Ā—ā–ĺ—á–Ĺ–ł–ļ–į —Ā–ĺ —Ā–ļ–ĺ—Ä–ĺ—Ā—ā—Ć—é –Ī–ĺ–Ľ—Ć—ą–Ķ–Ļ

. –ü–ĺ—ć—ā–ĺ–ľ—É –Ņ–Ķ—Ä–Ķ–ī–į–≤–į—ā—Ć —Ā–ł–ľ–≤–ĺ–Ľ—č –ł—Ā—ā–ĺ—á–Ĺ–ł–ļ–į —Ā–ĺ —Ā–ļ–ĺ—Ä–ĺ—Ā—ā—Ć—é –Ī–ĺ–Ľ—Ć—ą–Ķ–Ļ  –Ĺ–Ķ–≤–ĺ–∑–ľ–ĺ–∂–Ĺ–ĺ.

–Ĺ–Ķ–≤–ĺ–∑–ľ–ĺ–∂–Ĺ–ĺ.

–ü—Ä–ł–ľ–Ķ—á–į–Ĺ–ł—Ź

- ‚ÜĎ –í–į—Ä–≥–į—É–∑–ł–Ĺ –í. –ź., –¶–ł–ļ–ł–Ĺ –ė. –ź. –ú–Ķ—ā–ĺ–ī—č –Ņ–ĺ–≤—č—ą–Ķ–Ĺ–ł—Ź —ć–Ĺ–Ķ—Ä–≥–Ķ—ā–ł—á–Ķ—Ā–ļ–ĺ–Ļ –ł —Ā–Ņ–Ķ–ļ—ā—Ä–į–Ľ—Ć–Ĺ–ĺ–Ļ —ć—Ą—Ą–Ķ–ļ—ā–ł–≤–Ĺ–ĺ—Ā—ā–ł —Ü–ł—Ą—Ä–ĺ–≤–ĺ–Ļ —Ä–į–ī–ł–ĺ—Ā–≤—Ź–∑–ł, 2013. ‚ÄĒ –°. 22.

- ‚ÜĎ Geetam Singh Tomar, Bagwari Ashish. Analog Communications, 2016. ‚ÄĒ P. 266.

- ‚ÜĎ –ė–≤–į–Ĺ–ĺ–≤ –ė. –í. –Ę–Ķ–ĺ—Ä–ł—Ź –ł–Ĺ—Ą–ĺ—Ä–ľ–į—Ü–ł–ĺ–Ĺ–Ĺ—č—Ö –Ņ—Ä–ĺ—Ü–Ķ—Ā—Ā–ĺ–≤ –ł —Ā–ł—Ā—ā–Ķ–ľ. –£—á–Ķ–Ī–Ĺ–ĺ–Ķ –Ņ–ĺ—Ā–ĺ–Ī–ł–Ķ –ī–Ľ—Ź –į–ļ–į–ī–Ķ–ľ–ł—á–Ķ—Ā–ļ–ĺ–≥–ĺ –Ī–į–ļ–į–Ľ–į–≤—Ä–ł–į—ā–į, 2018. ‚ÄĒ –°. 123.

- ‚ÜĎ 1 2 –®–Ķ–Ĺ–Ĺ–ĺ–Ĺ –ö. –†–į–Ī–ĺ—ā—č –Ņ–ĺ —ā–Ķ–ĺ—Ä–ł–ł –ł–Ĺ—Ą–ĺ—Ä–ľ–į—Ü–ł–ł –ł –ļ–ł–Ī–Ķ—Ä–Ĺ–Ķ—ā–ł–ļ–Ķ, 1963. ‚ÄĒ –°. 270.

- ‚ÜĎ 1 2 –§–ł–Ĺ–ļ –õ. –ú. –Ę–Ķ–ĺ—Ä–ł—Ź –Ņ–Ķ—Ä–Ķ–ī–į—á–ł –ī–ł—Ā–ļ—Ä–Ķ—ā–Ĺ—č—Ö —Ā–ĺ–ĺ–Ī—Č–Ķ–Ĺ–ł–Ļ, 1970. ‚ÄĒ –°. 67.

- ‚ÜĎ 1 2 3 –®–Ķ–Ĺ–Ĺ–ĺ–Ĺ –ö. –†–į–Ī–ĺ—ā—č –Ņ–ĺ —ā–Ķ–ĺ—Ä–ł–ł –ł–Ĺ—Ą–ĺ—Ä–ľ–į—Ü–ł–ł –ł –ļ–ł–Ī–Ķ—Ä–Ĺ–Ķ—ā–ł–ļ–Ķ, 1963. ‚ÄĒ –°. 272.

- ‚ÜĎ –§–į–Ĺ–ĺ –†. –ú. –ü–Ķ—Ä–Ķ–ī–į—á–į –ł–Ĺ—Ą–ĺ—Ä–ľ–į—Ü–ł–ł. –°—ā–į—ā–ł—Ā—ā–ł—á–Ķ—Ā–ļ–į—Ź —ā–Ķ–ĺ—Ä–ł—Ź —Ā–≤—Ź–∑–ł, 1965. ‚ÄĒ –°. 90.

- ‚ÜĎ –ď–į–Ī–ł–ī—É–Ľ–ł–Ĺ –≠. –ú., –ü–ł–Ľ–ł–Ņ—á—É–ļ –Ě. –ė. –õ–Ķ–ļ—Ü–ł–ł –Ņ–ĺ —ā–Ķ–ĺ—Ä–ł–ł –ł–Ĺ—Ą–ĺ—Ä–ľ–į—Ü–ł–ł, 2007. ‚ÄĒ –°. 49‚ÄĒ52

- ‚ÜĎ 1 2 –§–į–Ĺ–ĺ –†. –ú. –ü–Ķ—Ä–Ķ–ī–į—á–į –ł–Ĺ—Ą–ĺ—Ä–ľ–į—Ü–ł–ł. –°—ā–į—ā–ł—Ā—ā–ł—á–Ķ—Ā–ļ–į—Ź —ā–Ķ–ĺ—Ä–ł—Ź —Ā–≤—Ź–∑–ł, 1965. ‚ÄĒ –°. 93‚ÄĒ94.

- ‚ÜĎ –§–į–Ĺ–ĺ –†. –ú. –ü–Ķ—Ä–Ķ–ī–į—á–į –ł–Ĺ—Ą–ĺ—Ä–ľ–į—Ü–ł–ł. –°—ā–į—ā–ł—Ā—ā–ł—á–Ķ—Ā–ļ–į—Ź —ā–Ķ–ĺ—Ä–ł—Ź —Ā–≤—Ź–∑–ł, 1965. ‚ÄĒ –°. 94.

- ‚ÜĎ Shannon C. E. A Mathematical Theory of Communication. The Bell System Technical Journal, 1948. ‚ÄĒ P. 16.

- ‚ÜĎ 1 2 3 David J. C. MacKay. Information Theory, Inference, and Learning Algorithms. ‚ÄĒ Cambridge University Press, 2003. ‚ÄĒ P. 97.

- ‚ÜĎ –§–į–Ĺ–ĺ –†. –ú. –ü–Ķ—Ä–Ķ–ī–į—á–į –ł–Ĺ—Ą–ĺ—Ä–ľ–į—Ü–ł–ł. –°—ā–į—ā–ł—Ā—ā–ł—á–Ķ—Ā–ļ–į—Ź —ā–Ķ–ĺ—Ä–ł—Ź —Ā–≤—Ź–∑–ł, 1965. ‚ÄĒ –°. 90‚ÄĒ91.

- ‚ÜĎ 1 2 3 David J. C. MacKay. Information Theory, Inference, and Learning Algorithms. ‚ÄĒ Cambridge University Press, 2003. ‚ÄĒ P. 98.

- ‚ÜĎ –§–į–Ĺ–ĺ –†. –ú. –ü–Ķ—Ä–Ķ–ī–į—á–į –ł–Ĺ—Ą–ĺ—Ä–ľ–į—Ü–ł–ł. –°—ā–į—ā–ł—Ā—ā–ł—á–Ķ—Ā–ļ–į—Ź —ā–Ķ–ĺ—Ä–ł—Ź —Ā–≤—Ź–∑–ł, 1965. ‚ÄĒ –°. 91‚ÄĒ92.

- ‚ÜĎ –®–Ķ–Ĺ–Ĺ–ĺ–Ĺ –ö. –†–į–Ī–ĺ—ā—č –Ņ–ĺ —ā–Ķ–ĺ—Ä–ł–ł –ł–Ĺ—Ą–ĺ—Ä–ľ–į—Ü–ł–ł –ł –ļ–ł–Ī–Ķ—Ä–Ĺ–Ķ—ā–ł–ļ–Ķ, 1963. ‚ÄĒ –°. 271.

- ‚ÜĎ –®–Ķ–Ĺ–Ĺ–ĺ–Ĺ –ö. –†–į–Ī–ĺ—ā—č –Ņ–ĺ —ā–Ķ–ĺ—Ä–ł–ł –ł–Ĺ—Ą–ĺ—Ä–ľ–į—Ü–ł–ł –ł –ļ–ł–Ī–Ķ—Ä–Ĺ–Ķ—ā–ł–ļ–Ķ, 1963. ‚ÄĒ –°. 266.