Энтропийная скоростьЭнтропийная скорость случайного процесса — в теории информации — величина, показывающая скорость возрастания энтропии при увеличении длины последовательности случайных величин, для которых она рассчитывается[1]. ФормулаЭнтропийная скорость является пределом совместной энтропии случайных величин , поделённым на , при стремлении к бесконечности[1]:

–µ—Å–ª–∏ –ø—Ä–µ–¥–µ–ª —Å—É—â–µ—Å—Ç–≤—É–µ—Ç. –ê–ª—å—Ç–µ—Ä–Ω–∞—Ç–∏–≤–Ω–æ —Å–≤—è–∑–∞–Ω–Ω–æ–π –≤–µ–ª–∏—á–∏–Ω–æ–π —è–≤–ª—è–µ—Ç—Å—è[2]:

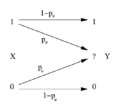

–í–µ–ª–∏—á–∏–Ω—ã –∏ —Å–æ–æ—Ç–≤–µ—Ç—Å—Ç–≤—É—é—Ç –¥–≤—É–º —Ä–∞–∑–ª–∏—á–Ω—ã–º –ø–æ–Ω—è—Ç–∏—è–º —Å–∫–æ—Ä–æ—Å—Ç–∏ —ç–Ω—Ç—Ä–æ–ø–∏–∏. –ü–µ—Ä–≤–∞—è ‚Äî —ç—Ç–æ —ç–Ω—Ç—Ä–æ–ø–∏—è –Ω–∞ —Å–∏–º–≤–æ–ª —Å–ª—É—á–∞–π–Ω—ã—Ö –≤–µ–ª–∏—á–∏–Ω, –∞ –≤—Ç–æ—Ä–∞—è ‚Äî —É—Å–ª–æ–≤–Ω–∞—è —ç–Ω—Ç—Ä–æ–ø–∏—è –ø–æ—Å–ª–µ–¥–Ω–µ–π —Å–ª—É—á–∞–π–Ω–æ–π –≤–µ–ª–∏—á–∏–Ω—ã, —É—á–∏—Ç—ã–≤–∞—è –ø—Ä–æ—à–ª—ã–µ. –î–ª—è —Å—Ç–∞—Ü–∏–æ–Ω–∞—Ä–Ω—ã—Ö —Å–ª—É—á–∞–π–Ω—ã—Ö –ø—Ä–æ—Ü–µ—Å—Å–æ–≤ –≤—ã–ø–æ–ª–Ω—è–µ—Ç—Å—è —Ä–∞–≤–µ–Ω—Å—Ç–≤–æ [2]. –≠–Ω—Ç—Ä–æ–ø–∏–π–Ω—É—é —Å–∫–æ—Ä–æ—Å—Ç—å –º–æ–∂–Ω–æ —Ä–∞—Å—Å–º–∞—Ç—Ä–∏–≤–∞—Ç—å –∫–∞–∫ –æ–±—â–µ–µ —Å–≤–æ–π—Å—Ç–≤–æ —Å–ª—É—á–∞–π–Ω—ã—Ö —ç—Ä–≥–æ–¥–∏—á–µ—Å–∫–∏—Ö –∏—Å—Ç–æ—á–Ω–∏–∫–æ–≤, —Ç–æ –µ—Å—Ç—å —Å–≤–æ–π—Å—Ç–≤–æ –∞—Å–∏–º–ø—Ç–æ—Ç–∏—á–µ—Å–∫–æ–π —Ä–∞–≤–Ω–æ—Ä–∞—Å–ø—Ä–µ–¥–µ–ª–µ–Ω–Ω–æ—Å—Ç–∏[3]. –≠–Ω—Ç—Ä–æ–ø–∏–π–Ω—É—é —Å–∫–æ—Ä–æ—Å—Ç—å –º–æ–∂–Ω–æ –∏—Å–ø–æ–ª—å–∑–æ–≤–∞—Ç—å –¥–ª—è –æ—Ü–µ–Ω–∫–∏ —Å–ª–æ–∂–Ω–æ—Å—Ç–∏ —Å–ª—É—á–∞–π–Ω—ã—Ö –ø—Ä–æ—Ü–µ—Å—Å–æ–≤. –û–Ω–∞ –∏—Å–ø–æ–ª—å–∑—É–µ—Ç—Å—è –≤ —Ä–∞–∑–ª–∏—á–Ω—ã—Ö –ø—Ä–∏–ª–æ–∂–µ–Ω–∏—è—Ö –æ—Ç –æ–ø–∏—Å–∞–Ω–∏—è —Å–ª–æ–∂–Ω–æ—Å—Ç–∏ —è–∑—ã–∫–æ–≤, —Å–ª–µ–ø–æ–≥–æ —Ä–∞–∑–¥–µ–ª–µ–Ω–∏—è —Å–∏–≥–Ω–∞–ª–æ–≤ –¥–æ –æ–ø—Ç–∏–º–∏–∑–∞—Ü–∏–∏ –ø—Ä–µ–æ–±—Ä–∞–∑–æ–≤–∞—Ç–µ–ª–µ–π –∏ –∞–ª–≥–æ—Ä–∏—Ç–º–æ–≤ —Å–∂–∞—Ç–∏—è –¥–∞–Ω–Ω—ã—Ö. –ù–∞–ø—Ä–∏–º–µ—Ä, –∫—Ä–∏—Ç–µ—Ä–∏–π –º–∞–∫—Å–∏–º–∞–ª—å–Ω–æ–π —ç–Ω—Ç—Ä–æ–ø–∏–π–Ω–æ–π —Å–∫–æ—Ä–æ—Å—Ç—å –º–æ–∂–µ—Ç –±—ã—Ç—å –∏—Å–ø–æ–ª—å–∑–æ–≤–∞–Ω –¥–ª—è –æ—Ç–±–æ—Ä–∞ –ø—Ä–∏–∑–Ω–∞–∫–æ–≤ –≤ –º–∞—à–∏–Ω–Ω–æ–º –æ–±—É—á–µ–Ω–∏–∏[4]. –ü—Ä–∏–º–µ—Ä—ã–Ý–∞—Å—Å–º–æ—Ç—Ä–∏–º –ø–æ—Å–ª–µ–¥–æ–≤–∞—Ç–µ–ª—å–Ω–æ—Å—Ç–∏ –∏–∑ —Å–ª—É—á–∞–π–Ω—ã—Ö –≤–µ–ª–∏—á–∏–Ω, –ø—Ä–∏–Ω–∏–º–∞—é—â–∏—Ö –∑–Ω–∞—á–µ–Ω–∏–π[1].

–≠–Ω—Ç—Ä–æ–ø–∏–π–Ω–∞—è —Å–∫–æ—Ä–æ—Å—Ç—å –¥–ª—è –º–∞—Ä–∫–æ–≤—Å–∫–∏—Ö —Ü–µ–ø–µ–π–î–ª—è —Å—Ç–∞—Ü–∏–æ–Ω–∞—Ä–Ω–æ–π —Ü–µ–ø–∏ –ú–∞—Ä–∫–æ–≤–∞, –æ–ø—Ä–µ–¥–µ–ª—ë–Ω–Ω–æ–π –Ω–∞ —Å—á—ë—Ç–Ω–æ–º —á–∏—Å–ª–µ —Å–æ—Å—Ç–æ—è–Ω–∏–π, –∑–∞–¥–∞–Ω–Ω—ã—Ö –º–∞—Ç—Ä–∏—Ü–µ–π –ø–µ—Ä–µ—Ö–æ–¥–æ–≤ , —ç–Ω—Ç—Ä–æ–ø–∏–π–Ω–∞—è —Å–∫–æ—Ä–æ—Å—Ç—å –∑–∞–¥–∞—ë—Ç—Å—è –≤—ã—Ä–∞–∂–µ–Ω–∏–µ–º[3]:

–≥–¥–µ —è–≤–ª—è–µ—Ç—Å—è —Ä–µ—à–µ–Ω–∏–µ–º —Å–∏—Å—Ç–µ–º—ã —É—Ä–∞–≤–Ω–µ–Ω–∏–π: –¥–ª—è –≤—Å–µ—Ö . –ï—Å–ª–∏ —Ü–µ–ø—å –ú–∞—Ä–∫–æ–≤–∞ –Ω–µ–ø—Ä–∏–≤–æ–¥–∏–º–∞ –∏ –Ω–µ–ø–µ—Ä–∏–æ–¥–∏—á–Ω–∞, —Ç–æ –æ–Ω–∞ –∏–º–µ–µ—Ç –µ–¥–∏–Ω—Å—Ç–≤–µ–Ω–Ω–æ–µ —Å—Ç–∞—Ü–∏–æ–Ω–∞—Ä–Ω–æ–µ —Ä–∞—Å–ø—Ä–µ–¥–µ–ª–µ–Ω–∏–µ –Ω–∞ —Å–æ—Å—Ç–æ—è–Ω–∏—è—Ö, –∏ –ª—é–±–æ–µ –Ω–∞—á–∞–ª—å–Ω–æ–µ —Ä–∞—Å–ø—Ä–µ–¥–µ–ª–µ–Ω–∏–µ —Å—Ç—Ä–µ–º–∏—Ç—Å—è –∫ —Å—Ç–∞—Ü–∏–æ–Ω–∞—Ä–Ω–æ–º—É —Ä–∞—Å–ø—Ä–µ–¥–µ–ª–µ–Ω–∏—é –ø—Ä–∏ . –í —ç—Ç–æ–º —Å–ª—É—á–∞–µ, –¥–∞–∂–µ –µ—Å–ª–∏ –Ω–∞—á–∞–ª—å–Ω–æ–µ —Ä–∞—Å–ø—Ä–µ–¥–µ–ª–µ–Ω–∏–µ –Ω–µ —è–≤–ª—è–µ—Ç—Å—è —Å—Ç–∞—Ü–∏–æ–Ω–∞—Ä–Ω—ã–º —Ä–∞—Å–ø—Ä–µ–¥–µ–ª–µ–Ω–∏–µ–º, —Å–∫–æ—Ä–æ—Å—Ç—å —ç–Ω—Ç—Ä–æ–ø–∏–∏, –∫–æ—Ç–æ—Ä–∞—è –æ–ø—Ä–µ–¥–µ–ª—è–µ—Ç—Å—è –≤ —Ç–µ—Ä–º–∏–Ω–∞—Ö –¥–æ–ª–≥–æ—Å—Ä–æ—á–Ω–æ–≥–æ –ø–æ–≤–µ–¥–µ–Ω–∏—è, —Ä–∞–≤–Ω–∞ [5]. –°–º. —Ç–∞–∫–∂–µ–ü—Ä–∏–º–µ—á–∞–Ω–∏—è

–õ–∏—Ç–µ—Ä–∞—Ç—É—Ä–∞

|

Portal di Ensiklopedia Dunia