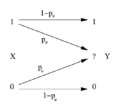

–¢–µ–æ—Ä–µ–º–∞ –®–µ–Ω–Ω–æ–Ω–∞ ‚Äî –•–∞—Ä—Ç–ª–∏–¢–µ–æ—Ä–µ–º–∞ –®–µ–Ω–Ω–æ–Ω–∞ ‚Äî –•–∞—Ä—Ç–ª–∏ (—Ñ–æ—Ä–º—É–ª–∞ –®–µ–Ω–Ω–æ–Ω–∞[1]) –≤ —Ç–µ–æ—Ä–∏–∏ –∏–Ω—Ñ–æ—Ä–º–∞—Ü–∏–∏ ‚Äî —Ñ–æ—Ä–º—É–ª–∞, —Å–≤—è–∑—ã–≤–∞—é—â–∞—è –ø—Ä–æ–ø—É—Å–∫–Ω—É—é —Å–ø–æ—Å–æ–±–Ω–æ—Å—Ç—å –∫–∞–Ω–∞–ª–∞ c –∞–¥–¥–∏—Ç–∏–≤–Ω—ã–º –±–µ–ª—ã–º –≥–∞—É—Å—Å–æ–≤—ã–º —à—É–º–æ–º —Å —à–∏—Ä–∏–Ω–æ–π –ø–æ–ª–æ—Å—ã –ø—Ä–æ–ø—É—Å–∫–∞–Ω–∏—è –∫–∞–Ω–∞–ª–∞ –∏ –æ—Ç–Ω–æ—à–µ–Ω–∏–µ–º —Å–∏–≥–Ω–∞–ª-—à—É–º[1][2][3]. –ù–∞–∑–≤–∞–Ω–∞ –≤ —á–µ—Å—Ç—å –ö–ª–æ–¥–∞ –®–µ–Ω–Ω–æ–Ω–∞ –∏ –Ý–∞–ª—å—Ñ–∞ –•–∞—Ä—Ç–ª–∏. –ë—ã–ª–∞ –¥–æ–∫–∞–∑–∞–Ω–∞ –ö–ª–æ–¥–æ–º –®–µ–Ω–Ω–æ–Ω–æ–º –≤ 1948 –≥–æ–¥—É[4]. –£—Ç–≤–µ—Ä–∂–¥–µ–Ω–∏–µ —Ç–µ–æ—Ä–µ–º—ã–¢–µ–æ—Ä–µ–º–∞ –®–µ–Ω–Ω–æ–Ω–∞ ‚Äî –•–∞—Ä—Ç–ª–∏ —É—Ç–≤–µ—Ä–∂–¥–∞–µ—Ç, —á—Ç–æ –ø—Ä–æ–ø—É—Å–∫–Ω–∞—è —Å–ø–æ—Å–æ–±–Ω–æ—Å—Ç—å –Ω–µ–ø—Ä–µ—Ä—ã–≤–Ω–æ–≥–æ –∫–∞–Ω–∞–ª–∞ c –∞–¥–¥–∏—Ç–∏–≤–Ω—ã–º –±–µ–ª—ã–º –≥–∞—É—Å—Å–æ–≤—ã–º —à—É–º–æ–º —Å–≤—è–∑–∞–Ω–∞ —Å —à–∏—Ä–∏–Ω–æ–π –ø–æ–ª–æ—Å—ã –ø—Ä–æ–ø—É—Å–∫–∞–Ω–∏—è –∫–∞–Ω–∞–ª–∞ –∏ –æ—Ç–Ω–æ—à–µ–Ω–∏–µ–º —Å–∏–≥–Ω–∞–ª-—à—É–º –ø–æ —Ñ–æ—Ä–º—É–ª–µ: –≥–¥–µ

–ö–ª–æ–¥ –®–µ–Ω–Ω–æ–Ω —É—Ç–≤–µ—Ä–∂–¥–∞–ª, —á—Ç–æ —ç—Ç–∞ —Ñ–æ—Ä–º—É–ª–∞ –æ–∑–Ω–∞—á–∞–µ—Ç, —á—Ç–æ —Å –ø–æ–º–æ—â—å—é –¥–æ—Å—Ç–∞—Ç–æ—á–Ω–æ —Å–ª–æ–∂–Ω—ã—Ö —Å–∏—Å—Ç–µ–º –∫–æ–¥–∏—Ä–æ–≤–∞–Ω–∏—è –º–æ–∂–Ω–æ –ø–µ—Ä–µ–¥–∞–≤–∞—Ç—å –¥–≤–æ–∏—á–Ω—ã–µ –∑–Ω–∞–∫–∏ —Å–æ —Å–∫–æ—Ä–æ—Å—Ç—å—é –ø—Ä–∏ —Å–∫–æ–ª—å —É–≥–æ–¥–Ω–æ –º–∞–ª–æ–π —á–∞—Å—Ç–æ—Ç–µ –æ—à–∏–±–æ–∫. –ù–µ–≤–æ–∑–º–æ–∂–Ω–æ –ø–µ—Ä–µ–¥–∞–≤–∞—Ç—å —Å –±–æ–ª—å—à–µ–π —Å–∫–æ—Ä–æ—Å—Ç—å—é –ø—Ä–∏ –ª—é–±–æ–π —Å–∏—Å—Ç–µ–º–µ –∫–æ–¥–∏—Ä–æ–≤–∞–Ω–∏—è –±–µ–∑ —Ç–æ–≥–æ, —á—Ç–æ–±—ã —á–∞—Å—Ç–æ—Ç–∞ –æ—à–∏–±–æ–∫ –Ω–µ –±—ã–ª–∞ –±—ã –ø–æ–ª–æ–∂–∏—Ç–µ–ª—å–Ω–∞. –î–ª—è –¥–æ—Å—Ç–∏–∂–µ–Ω–∏—è —ç—Ç–æ–π –ø—Ä–µ–¥–µ–ª—å–Ω–æ–π —Å–∫–æ—Ä–æ—Å—Ç–∏ –ø–µ—Ä–µ–¥–∞–≤–∞–µ–º—ã–µ —Å–∏–≥–Ω–∞–ª—ã –¥–æ–ª–∂–Ω—ã –±—ã—Ç—å –±–ª–∏–∑–∫–∏ –ø–æ —Å–≤–æ–∏–º —Å—Ç–∞—Ç–∏—Å—Ç–∏—á–µ—Å–∫–∏–º —Å–≤–æ–π—Å—Ç–≤–∞–º –∫ –±–µ–ª–æ–º—É —à—É–º—É. –ü—Ä–∏ —ç—Ç–æ–º –¥–ª–∏—Ç–µ–ª—å–Ω–æ—Å—Ç—å —Å–∏–≥–Ω–∞–ª–∞ –¥–æ–ª–∂–Ω–∞ –±—ã—Ç—å –¥–æ—Å—Ç–∞—Ç–æ—á–Ω–æ –±–æ–ª—å—à–æ–π[5]. –ü—Ä–∏ —ç—Ç–æ–º –¥–∞–∂–µ –±–µ—Å–∫–æ–Ω–µ—á–Ω–æ–µ —É–≤–µ–ª–∏—á–µ–Ω–∏–µ –ø–æ–ª–æ—Å—ã –Ω–µ –ø—Ä–∏–≤–æ–¥–∏—Ç –∫ –±–µ—Å–∫–æ–Ω–µ—á–Ω–æ–º—É —Ä–æ—Å—Ç—É –ø—Ä–æ–ø—É—Å–∫–Ω–æ–π —Å–ø–æ—Å–æ–±–Ω–æ—Å—Ç–∏ [1]:

Пропускная способность непрерывного канала с шумом, отличным от гауссова, или с шумом, энергетический спектр которого неравномерен в полосе пропускания канала, оказывается больше вычисленной по формуле Шеннона — Хартли[6]. Граница Шеннона Формулу Шеннона — Хартли можно переписать в виде, получив формулу, называемую границей Шеннона[7]:

где — удельные энергетические затраты, — энергия сигнала, затрачиваемая на передачу одного бита информации, — спектральная плотность мощности шума, — скорость создания информации (при равновероятных и независимых символах источника).

–¢–∞–∫ –∫–∞–∫ –ø–æ —É—Å–ª–æ–≤–∏—é —Ç–µ–æ—Ä–µ–º—ã –®–µ–Ω–Ω–æ–Ω–∞ –¥–ª—è –∫–∞–Ω–∞–ª–∞ —Å —à—É–º–æ–º –¥–ª—è –±–µ–∑–æ—à–∏–±–æ—á–Ω–æ–≥–æ –≤–æ—Å–ø—Ä–æ–∏–∑–≤–µ–¥–µ–Ω–∏—è —Å–æ–æ–±—â–µ–Ω–∏–π –Ω–µ–æ–±—Ö–æ–¥–∏–º–æ –≤—ã–ø–æ–ª–Ω–µ–Ω–∏–µ —É—Å–ª–æ–≤–∏—è , —Ç–æ —É–¥–µ–ª—å–Ω—ã–µ —ç–Ω–µ—Ä–≥–µ—Ç–∏—á–µ—Å–∫–∏–µ –∑–∞—Ç—Ä–∞—Ç—ã –¥–æ–ª–∂–Ω—ã —É–¥–æ–≤–ª–µ—Ç–≤–æ—Ä—è—Ç—å —Å–ª–µ–¥—É—é—â–µ–º—É –Ω–µ—Ä–∞–≤–µ–Ω—Å—Ç–≤—É: —Ç–æ –µ—Å—Ç—å –≤–µ–ª–∏—á–∏–Ω–∞ –¥–æ–ª–∂–Ω–∞ –±—ã—Ç—å –≤—ã—à–µ –≥—Ä–∞–Ω–∏—Ü—ã –®–µ–Ω–Ω–æ–Ω–∞[7]. –ü—Ä–∏ –≤–µ–ª–∏—á–∏–Ω–µ –º–∏–Ω–∏–º–∞–ª—å–Ω–æ –≤–æ–∑–º–æ–∂–Ω–æ–µ –∑–Ω–∞—á–µ–Ω–∏–µ , –Ω–∞–∑—ã–≤–∞–µ–º–æ–µ –ø—Ä–µ–¥–µ–ª–æ–º –®–µ–Ω–Ω–æ–Ω–∞[6]. –¢–∞–∫–∏–º –æ–±—Ä–∞–∑–æ–º, –≤–µ–ª–∏—á–∏–Ω–∞ —É–¥–µ–ª—å–Ω—ã—Ö —ç–Ω–µ—Ä–≥–µ—Ç–∏—á–µ—Å–∫–∏—Ö –∑–∞—Ç—Ä–∞—Ç –¥–ª—è –∫–∞–Ω–∞–ª–∞ —Å –ê–ë–ì–®, –¥–∞–∂–µ –ø—Ä–∏ , –¥–æ–ª–∂–Ω–∞ –ø—Ä–µ–≤–æ—Å—Ö–æ–¥–∏—Ç—å –∑–Ω–∞—á–µ–Ω–∏–µ [8]. –ü—Ä–∏–º–µ—á–∞–Ω–∏—è

|

Portal di Ensiklopedia Dunia