Теорія інформації

Тео́рія інформ́ації (англ. Information theory) — це математичне дослідження кількісного вираження, зберігання та передавання інформації. Заснував цю галузь і забезпечив їй надійну основу Клод Шеннон у 1940-х роках,[1] хоча ранній внесок до цьому напряму зробили в 1920-х роках праці Гаррі Найквіста та Ральфа Гартлі. Вона перебуває на перетині електронної інженерії, математики, статистики, інформатики, нейробіології, фізики та електротехніки.[2][3] Ключовою мірою в теорії інформації є ентропія. Ентропія вимірює рівень невизначеності щодо значення випадкової величини або результату випадкового процесу. Наприклад, визначення результату підкидання симетричної монети (що має два рівноймовірні результати) дає менше інформації (меншу ентропію, меншу невизначеність), аніж визначення результату кидання гральної кісточки (що має шість рівноймовірних результатів). До інших важливих мір у теорії інформації належать взаємна інформація, пропускна спроможність каналу, показники помилок та відносна ентропія. До важливих підрозділів теорії інформації належать кодування джерела, алгоритмічна теорія складності, алгоритмічна теорія інформації та інформаційно-теоретична безпека. До застосувань основних предметів теорії інформації належать кодування джерела/стиснення даних (наприклад, для файлів zip) та канальне кодування/виявляння та виправляння помилок (наприклад, для DSL). Її вплив був вирішальним для успіху місій «Вояджер» до глибокого космосу,[4] винайдення компакт-диска, можливості мобільних телефонів і розвитку Інтернету й штучного інтелекту.[5][3] Ця теорія також знайшла застосування й в інших сферах, як-от індуктивній статистиці,[6] криптографії, нейробіології,[7] сприйнятті,[8] обробці сигналів,[2] мовознавстві, еволюції[9] та функціюванні[10] молекулярних кодів (біоінформатиці), теплофізиці,[11] молекулярній динаміці,[12] чорних дірах, квантових обчисленнях, інформаційному пошуку, збиранні інформації, виявлянні плагіату,[13] розпізнаванні образів, виявлянні аномалій,[14] музичній аналітиці,[15][16] створенні живопису,[17] проєктуванні систем зображування,[18] вивченні космічного простору,[19] вимірності простору,[20] і навіть епістемології.[21] ОглядТеорія інформації вивчає передавання, обробку, виділяння та використання інформації. Абстрактно інформацію можливо розглядати як розв'язання невизначеності. У випадку передавання інформації зашумленим каналом це абстрактне поняття формалізував 1948 року Клод Шеннон у статті під назвою «Математична теорія зв'язку», в якій інформацію розглянуто як набір можливих повідомлень, а метою є передавання цих повідомлень зашумленим каналом, щоби приймач міг відтворити повідомлення з низькою ймовірністю помилки, незважаючи на шум каналу. Головний результат Шеннона, теорема про кодування для зашумленого каналу, показав, що за великої кількості використань каналу швидкість передачі інформації, яка асимптотично досяжна, дорівнює пропускній спроможності каналу, величині, яка залежить лише від статистичних характеристик каналу, яким передають повідомлення.[7] Теорія кодування займається пошуком конкретних методів, званих кодами (англ. codes), для підвищення ефективності та зниження рівня помилок при передаванні даних зашумленими каналами, з наближенням до пропускної спроможності каналу. Ці коди можливо умовно поділити на методи стискання даних (кодування джерела) та виправляння помилок (кодування каналу). У випадку останнього знадобилося багато років, щоби знайти методи, можливість яких довів Шеннон.[джерело?] Третій клас кодів у теорії інформації — алгоритми шифрування (як коди, так і шифри). Поняття, методи й результати з теорії кодування та теорії інформації широко використовують у криптографії та криптоаналізі, наприклад, одиничний бан.[джерело?] Історичне підґрунтяЗнаковою подією, що заклала основу дисципліни теорії інформації та привернула до неї негайну світову увагу, стала публікація класичної статті Клода Е. Шеннона «Математична теорія зв'язку» в Bell System Technical Journal у липні та жовтні 1948 року. Історик Джеймс Ґлік оцінив цю статтю як найважливіше досягнення 1948 року, вище за транзистор, зазначивши, що ця праця була «навіть глибшою й фундаментальнішою» за транзистор.[22] Шеннон став відомим як «батько теорії інформації».[23][24][25] Він викладав деякі зі своїх початкових ідей щодо теорії інформації ще 1939 року в листі до Веннівера Буша.[25] До цієї статті обмежені інформаційно-теоретичні ідеї розробили в Bell Labs, при цьому всі вони неявно виходили з однакової ймовірності подій. У своїй статті 1924 року «Деякі чинники, які впливають на швидкість телеграфу» (англ. Certain Factors Affecting Telegraph Speed) Гаррі Найквіст помістив теоретичний розділ, де кількісно визначив «відомості» (англ. "intelligence") та «швидкість лінії» (англ. "line speed"), з якою їх можливо передавати комунікаційною системою, встановивши співвідношення W = K log m (що нагадує сталу Больцмана), де W — швидкість передачі відомостей, m — кількість різних рівнів напруги, з яких можна обирати на кожному часовому кроці, а K — стала. Стаття Ральфа Гартлі 1928 року «Передавання інформації» (англ. Transmission of Information) використовує термін інформація (англ. information) як вимірювану величину, що відображає здатність приймача розрізняти одну послідовність символів з будь-якими іншими, тим самим кількісно визначаючи інформацію як H = log Sn = n log S, де S — кількість можливих символів, а n — кількість символів у передаванні. Отже, одиницею інформації була десяткова цифра, яку згодом іноді називали гартлі на його честь як одиницю, шкалу або міру інформації. 1940 року Алан Тюрінг використав подібні ідеї як частину статистичного аналізу для розшифровки німецьких шифрів «Енігми» під час Другої світової війни.[джерело?] Більшість математичного апарату теорії інформації для різноймовірнісних подій розробили для галузі термодинаміки Людвіг Больцман та Джозая Віллард Ґіббз. Зв'язки між інформаційною ентропією та термодинамічною ентропією, включно з важливими внесками Рольфа Ландауера 1960-х років, розглянуто в статті «Ентропія в термодинаміці та теорії інформації».[джерело?] У революційній і новаторській статті Шеннона, роботу над якою було значною мірою завершено в Bell Labs до кінця 1944 року, Шеннон уперше представив якісну та кількісну модель зв'язку як статистичний процес, що лежить в основі теорії інформації, розпочавши з твердження:

З нею прийшли ідеї:

Кількості інформації

Теорія інформації ґрунтується на теорії ймовірностей та статистиці, де кількісно виражену інформацію зазвичай описують у бітах. Теорія інформації часто займається вимірюванням інформації в розподілах, пов'язаних із випадковими величинами. Однією з найважливіших мір є ентропія, що є основою для багатьох інших мір. Ентропія дозволяє кількісно виразити міру інформації в окремій випадковій величині.[26] Іншим корисним поняттям є взаємна інформація, визначена для двох випадкових величин, яка описує міру інформації, спільної між цими величинами, що можливо використовувати для опису їхньої кореляції. Перша величина є властивістю розподілу ймовірності випадкової величини й визначає границю швидкості, з якою дані, породжені незалежними зразками із заданим розподілом, можливо надійно стиснути. Друга є властивістю спільного розподілу двох випадкових величин і є максимальною швидкістю надійного передавання зашумленим каналом в границі довжин блоків, коли статистика каналу визначається цим спільним розподілом. Вибір основи логарифму в наступних формулах визначає вживану одиницю інформаційної ентропії. Загальновживаною одиницею інформації є біт або шеннон, що ґрунтується на двійковому логарифмі. До інших одиниць належать нат, що ґрунтується на натуральному логарифмі, та десяткова цифра, що ґрунтується на десятковому логарифмі. Далі вираз вигляду p log p, коли p = 0, вважають за згодою нульовим. Це виправдано тим, що для будь-якої основи логарифму. Ентропія інформаційного джерелаВиходячи з функції маси ймовірності кожного символу джерела, що передається, ентропію Шеннона H у бітах (на символ) задають як де pi — ймовірність трапляння i-того можливого значення символу джерела. Це рівняння дає ентропію в одиницях «біт» (на символ), оскільки воно використовує логарифм з основою 2, і таку міру ентропії на основі логарифму за основою 2 іноді називають шенноном на його честь. Ентропію також часто обчислюють, використовуючи натуральний логарифм (з основою e, де e — число Ейлера), що дає вимірювання ентропії в натах на символ й іноді спрощує аналіз, усуваючи потребу в додаткових сталих у формулах. Можливі й інші основи, хоча їх використовують рідше. Наприклад, логарифм з основою 28 = 256 дає вимірювання в байтах на символ, а логарифм з основою 10 — у десяткових цифрах (або гартлі) на символ. Інтуїтивно, ентропія HX дискретної випадкової величини X є мірою невизначеності (англ. uncertainty), пов'язаної зі значенням X, коли відомий лише її розподіл. Ентропія джерела, яке видає послідовність з N символів, які незалежні й однаково розподілені (н. о. р.), дорівнює N ⋅ H біт (на повідомлення з N символів). Якщо символи даних джерела однаково розподілені, але не незалежні, ентропія повідомлення довжиною N буде меншою за N ⋅ H.  Якщо передати 1000 бітів (нулів та одиниць), але значення кожного з цих бітів відоме приймачу (має певне значення з упевненістю) ще до передачі, то очевидно, що жодної інформації не передано. Якщо ж кожен біт незалежно й однаково правдоподібно може бути 0 або 1, то передано 1000 шеннонів інформації (частіше званих бітами). Між цими двома крайнощами інформацію можливо кількісно виразити наступним чином. Якщо — множина всіх повідомлень {x1, ..., xn}, якими може бути X, а p(x) — імовірність деякого , то ентропію H величини X визначають як[27] (Тут I(x) — власна інформація, що є внеском ентропії окремого повідомлення, а — математичне сподівання.) Однією з властивостей ентропії є те, що вона максимізується, коли всі повідомлення у просторі повідомлень рівноймовірні, тобто p(x) = 1/n, тобто найнепередбачуваніші, й у такому випадку H(X) = log n. Особливий випадок інформаційної ентропії для випадкової величини з двома можливими результатами — функція бінарної ентропії, зазвичай з логарифмом за основою 2, що відтак має одиницею шеннон (Sh): Спільна ентропіяСпільна ентропія (англ. joint entropy) двох дискретних випадкових величин X та Y — це просто ентропія їхньої двійки: (X, Y). Це означає, що якщо X та Y незалежні, то їхня спільна ентропія дорівнює сумі їхніх окремих ентропій. Наприклад, якщо (X, Y) подає положення шахової фігури — X це рядок, а Y це стовпець, то спільна ентропія рядка та стовпця фігури буде ентропією її положення. Попри схожість позначень, спільну ентропію не слід плутати з перехресною ентропією (англ. cross-entropy). Умовна ентропія (неоднозначність)Умовна ентропія (англ. conditional entropy) або умовна невизначеність (англ. conditional uncertainty) величини X за заданої випадкової величини Y (також звана неоднозначністю[28] X щодо Y, англ. equivocation) — це усереднена умовна ентропія за Y:[29] Оскільки ентропія може бути обумовлена випадковою величиною (загальна умовна ентропія) або конкретним значенням цієї випадкової величини (часткова умовна ентропія),[30][31] слід бути уважними, щоби не плутати ці два визначення умовної ентропії, перше з яких є поширенішим. Основною властивістю цієї форми умовної ентропії є те, що Взаємна інформація (трансінформація)Взаємна інформація (англ. mutual information) вимірює кількість інформації про одну випадкову величину, яку можливо отримати, спостерігаючи іншу. Вона важлива в комунікаціях, де її можливо використовувати для максимізування кількості спільної інформації між передаваним та отримуваним сигналами. Взаємну інформацію X відносно Y визначають як де SI (англ. Specific mutual Information, конкретна взаємна інформація) — це поточкова взаємна інформація. Основна властивість взаємної інформації полягає в тому, що Тобто, знаючи Y, можливо заощадити в середньому I(X; Y) бітів при кодуванні X порівняно з ситуацією, коли Y невідома. Взаємна інформація симетрична: Взаємну інформацію можливо виразити як усереднення розходження Кульбака — Лейблера (приросту інформації) апостеріорного розподілу ймовірності X за заданого значення Y з апріорним розподілом X: Іншими словами, це міра того, наскільки в середньому зміниться розподіл імовірності X, якщо задано значення Y. Її часто переобчислюють як розходження добутку відособлених розподілів зі справжнім спільним розподілом: Взаємна інформація тісно пов'язана з критерієм логарифмічного співвідношення правдоподібностей у контексті таблиць спряженості та поліноміального розподілу, а також із критерієм χ2 Пірсона: взаємну інформацію можливо вважати статистикою для оцінювання незалежності пари змінних, і вона має добре визначений асимптотичний розподіл. Розходження Кульбака — Лейблера (приріст інформації)Розходження Кульбака — Лейблера (англ. Kullback–Leibler divergence, або розходження інформації, англ. information divergence, приріст інформації, англ. information gain, чи відносна ентропія, англ. relative entropy) — це спосіб порівняння двох розподілів: «істинного» розподілу ймовірності та довільного розподілу . Якщо ми стискаємо дані, вважаючи, що їхній розподіл це , тоді як насправді правильний розподіл це , розходження Кульбака–Лейблера визначає середню кількість додаткових бітів на дані, необхідних для стискання. Його відтак визначають як Хоча іноді його й використовують як «метрику відстані», КЛ-розходження не є справжньою метрикою, оскільки воно не симетричне й не задовольняє нерівність трикутника (що робить його напів-квазиметрикою). Іншим тлумаченням КЛ-розходження є «зайва несподіваність» (англ. "unnecessary surprise"), створювана апріорним розподілом у порівнянні з істинним: припустімо, що число X буде випадковим чином обрано з дискретної множини з розподілом ймовірності . Якщо Аліса знає істинний розподіл , а Боб вважає (має апріорне переконання), що цим розподілом є , то для Боба побачене значення X у середньому буде більш несподіваним, аніж для Аліси. КЛ-розходження є (об'єктивним) очікуваним значенням (суб'єктивної) несподіваності для Боба, мінус несподіваність для Аліси, виміряним у бітах, якщо логарифм взято за основою 2. Таким чином, міру того, наскільки «помилковим» є апріорне переконання Боба, можливо кількісно виразити у вигляді очікуваної «зайвої несподіваності» для нього. Спрямована інформаціяСпрямована інформація (англ. directed Information) — це міра в теорії інформації, що кількісно визначає інформаційний потік від випадкового процесу до випадкового процесу . Термін спрямована інформація запровадив Джеймс Мессі, її визначено як

де — умовна взаємна інформація . На відміну від взаємної інформації, спрямована інформація не симетрична. вимірює кількість інформації, що передається причинно[прояснити: ком.] від до . Спрямована інформація знаходить широке застосування в задачах, де важливу роль відіграє причинність, як-от пропускна спроможність каналу зі зворотним зв'язком,[32][33] пропускна спроможність дискретних мереж без пам'яті зі зворотним зв'язком,[34] ставки з причинною додатковою інформацією,[35] стиснення з причинною додатковою інформацією,[36] постановки комунікації керування в реальному часі,[37][38] та у статистичній фізиці.[39] Інші кількостіДо інших важливих інформаційно-теоретичних кількостей належать ентропія Реньї та ентропія Цалліса (узагальнення поняття ентропії), диференціальна ентропія (узагальнення кількостей інформації для неперервних розподілів) та умовна взаємна інформація. Також було запропоновано прагматичну інформацію як міру кількості інформації, використаної для ухвалення рішення. Теорія кодування

Теорія кодування — одне з найважливіших і найбезпосередніших застосувань теорії інформації. Її можливо поділити на теорію кодування джерела та теорію кодування каналу. Використовуючи статистичний опис даних, теорія інформації визначає кількість бітів, необхідних для опису даних, що є інформаційною ентропією джерела.

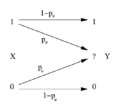

Цей поділ теорії кодування на стиснення й передавання обґрунтовано теоремами про передавання інформації, або теоремами про розділення джерела й каналу, які підтверджують використання бітів як універсальної валюти для інформації в багатьох контекстах. Проте ці теореми справедливі лише в ситуаціях, коли один передавач прагне спілкуватися з одним приймачем. У випадках, коли є понад одного передавача (канал із множинним доступом), понад одного приймача (канал мовлення) або проміжні «помічники» (ретрансляційний канал, англ. relay channel), чи для загальніших мереж, стиснення з подальшим передавання може вже не бути оптимальним. Теорія джерелаБудь-який процес, що породжує послідовні повідомлення, можливо розглядати як джерело (англ. source) інформації. Джерело без пам'яті (англ. memoryless) — це таке джерело, в якому кожне повідомлення — незалежна й однаково розподілена випадкова величина, тоді як властивості ергодичності та стаціонарності накладають менш жорсткі обмеження. Усі такі джерела стохастичні. Ці терміни добре вивчені й поза межами теорії інформації. ШвидкістьІнформаційна швидкість (англ. rate) — це усереднена ентропія на символ. Для джерел без пам'яті це просто ентропія кожного символу, тоді як у випадку стаціонарного стохастичного процесу це тобто умовна ентропія символу за заданих всіх попередньо породжених символів. Для загальнішого випадку не обов'язково стаціонарного процесу середня швидкість (англ. average rate) це тобто границя спільної ентропії на символ. Для стаціонарних джерел ці два вирази дають однаковий результат.[40] Інформаційну швидкість (англ. information rate) визначають як У теорії інформації часто говорять про «швидкість» або «ентропію» мови. Це доречно, наприклад, коли джерело інформації — англомовна проза. Швидкість джерела інформації пов'язана з його надмірністю та можливістю стиснення, що є предметом кодування джерела. Пропускна спроможність каналуПередавання інформації каналом — основний мотив теорії інформації. Проте канали часто не забезпечують точного відтворення сигналу; його якість часто можуть знижувати шум, періоди тиші та інші форми спотворення сигналу. Розгляньмо процес передавання дискретним каналом. Просту модель процесу подано нижче: Тут X подає простір передаваних повідомлень, а Y — простір отримуваних повідомлень за одиницю часу нашим каналом. Нехай p(y|x) — умовна ймовірність Y за заданого X. Розгляньмо p(y|x) як притаманну незмінну властивість нашого каналу (що відображає природу його шуму). Тоді спільний розподіл X та Y повністю визначається нашим каналом і вибором f(x), відособленого розподілу повідомлень, які ми обираємо для передавання каналом. За цих обмежень ми би хотіли максимізувати швидкість інформації, або сигнал, який можливо передавати цим каналом. Відповідною мірою для цього є взаємна інформація, і цю максимальну взаємну інформацію називають пропускною спроможністю каналу (англ. channel capacity), та задають як Ця пропускна спроможність має наступну властивість, пов'язану з передаванням на інформаційній швидкості R (де R зазвичай вимірюють у бітах на символ). Для будь-якої інформаційної швидкості R < C та похибки кодування ε > 0, за достатньо великого N, існує кодування довжини N, швидкість ≥ R та алгоритм декодування, такі, що максимальна ймовірність помилки в блоці ≤ ε; тобто завжди можливо передавати з довільно малою блоковою похибкою. Крім того, для будь-якої швидкості R > C передавати з довільно малою блоковою похибкою неможливо. Канальне кодування (англ. channel coding) займається пошуком таких майже оптимальних кодувань, які можливо використовувати для передавання даних зашумленим каналом з невеликою кодувальною похибкою на швидкості, наближеній до пропускної спроможності каналу. Пропускна спроможність окремих моделей каналів

Канали з пам'яттю та спрямована інформаціяНа практиці багато каналів мають пам'ять. Тобто, у момент часу канал визначається умовною ймовірністю . Часто зручніше використовувати запис , тоді канал стає . У такому випадку пропускна спроможність визначається швидкістю взаємної інформації, коли зворотний зв'язок недоступний, та швидкістю спрямованої інформації, якщо зворотний зв'язок наявний чи відсутній[32][41] (якщо зворотний зв'язок відсутній, спрямована інформація дорівнює взаємній інформації). Замінна інформаціяЗамінна інформація (англ. fungible information) — це інформація, для якої засоби кодування не мають значення.[42] Класичні теоретики інформації та спеціалісти з комп'ютерних наук здебільшого цікавляться інформацією саме цього типу. Іноді її називають вимовною (англ. speakable) інформацією.[43] Застосування в інших галузяхВикористання в розвідці та прикладна секретність

Поняття теорії інформації застосовні до криптографії та криптоаналізу. Одиницю інформації, введену Тюрінгом — бан, використовували у проекті «Ультра» для зламування коду німецької машини «Енігма», що прискорило завершення Другої світової війни в Європі. Сам Шеннон визначив важливе поняття, відоме тепер як відстань єдиності. Виходячи з надмірності відкритого тексту, це поняття намагається оцінити мінімальну кількість шифротексту, необхідну для забезпечення унікальної розшифровуваності. Теорія інформації підказує нам, що зберігати секрети набагато складніше, ніж може здатися на перший погляд. Атака повним перебором може зламувати системи на основі асиметричних ключів, або більшості широко використовуваних методів шифрування з симетричними ключами (іноді званих алгоритмами з секретним ключем), як-от блокового шифру. Безпека всіх таких методів ґрунтується на припущенні, що не існує відомих атак, здатних зламати їх за практично прийнятний час. Інформаційно-теоретична безпека охоплює такі методи як одноразовий блокнот, що не вразливі до подібних атак повним перебором. У таких випадках додатна умовна взаємна інформація між відкритим і шифрованим текстом (обумовлена ключем) може забезпечувати належну передачу, тоді як безумовна взаємна інформація між відкритим і шифрованим текстом залишається нульовою, що забезпечує абсолютно захищений зв'язок. Іншими словами, перехоплювач не зможе покращити свої припущення щодо відкритого тексту, здобувши інформацію про шифротекст без ключа. Проте, як і в будь-якій іншій криптографічній системі, для правильного застосування навіть інформаційно-теоретично захищених методів потрібно бути уважними; проєкт «Венона» виявився здатним зламати одноразові блокноти Радянського Союзу через їхнє неналежне повторне використання ключового матеріалу. Генерування псевдовипадкових чисел

Генератори псевдовипадкових чисел широко доступні в бібліотеках мов програмування та прикладних програмах. Проте майже повсюдно вони непридатні для криптографічного застосування, оскільки не обходять детерміновану природу сучасного комп'ютерного обладнання та програмного забезпечення. Один з класів удосконалених генераторів випадкових чисел називають криптографічно стійкими генераторами псевдовипадкових чисел, але навіть вони потребують для належної роботи випадкових початкових значень ззовні програмного забезпечення. Їх можливо отримувати за допомогою екстракторів, якщо робити це належним чином. Мірою достатньої випадковості в екстракторах є мін-ентропія, величина, пов'язана з ентропією Шеннона через ентропію Реньї; ентропію Реньї також використовують для оцінювання випадковості в криптографічних системах. Хоч ці міри й пов'язані, відмінності між ними означають, що випадкова величина з високою ентропією Шеннона не обов'язково задовільна для використання в екстракторі та, відповідно, в криптографії. Сейсмічна розвідкаОдним із ранніх комерційних застосувань теорії інформації була галузь сейсмічного розвідування нафти. Робота в цій галузі уможливила відокремлювання небажаного шуму від потрібного сейсмічного сигналу. Теорія інформації та цифрова обробка сигналів пропонують значне підвищення роздільності та чіткості зображень порівняно з попередніми аналоговими методами.[44] СеміотикаСеміотики Дуде Наута та Вінфрід Ньот у своїх працях із семіотики розглядали Чарлза Сандерса Пірса як творця теорії інформації.[45][46] Наута визначав семіотичну теорію інформації як дослідження «внутрішніх процесів кодування, фільтрування та обробки інформації.»[45] Поняття з теорії інформації, як-от керування надмірністю та кодом, використовували такі семіотики як Умберто Еко та Ферруччо Россі-Ланді для пояснення ідеології як форми передавання повідомлення, за якої домінантний соціальний клас передає своє повідомлення, використовуючи знаки з високим рівнем надмірності, так що з множини конкурентних повідомлень декодується лише одне.[47] Організація інтегрованої обробки нейронної інформаціїКількісні методи теорії інформації застосували у когнітивістиці для аналізу організації інтегрованої обробки нейронної інформації в контексті проблеми зв'язування в когнітивній нейронауці.[48] У цьому контексті визначають або інформаційно-теоретичну міру, таку як функційні кластери (англ. functional clusters, модель функційного кластерування та гіпотеза динамічного ядра (ГДЯ, англ. dynamic core hypothesis, DCH) Джеральда Едельмана та Джуліо Тононі[49]) або ефективна інформація (англ. effective information, теорія інтегрованої інформації (ТІІ, англ. integrated information theory, IIT) свідомості Тононі[50][51][52]), що ґрунтується на повторновикористовній організації обробки, тобто синхронізації нейрофізіологічної активності між групами нейронних сукупностей, або міру мінімізації вільної енергії на основі статистичних методів (принцип вільної енергії Карла Фрістана, інформаційно-теоретична міра, яка стверджує, що кожна адаптивна зміна в самоорганізовній системі веде до мінімізації вільної енергії, та гіпотеза баєсового мозку[53][54][55][56][57]). Інші застосуванняТеорія інформації також знаходить застосування у пошуку позаземного розуму,[58] дослідженні чорних дір, біоінформатиці[джерело?], та ста́вках. Див. також

ЗастосуванняІсторія

Теорія

Поняття

Примітки

ЛітератураКласичні праці

Інші журнальні статті

Підручники з теорії інформації

Українською

Інші книги

ПосиланняВікіцитати містять висловлювання від або про: Теорія інформації

|

Portal di Ensiklopedia Dunia

![{\displaystyle H(X)=\mathbb {E} _{X}[I(x)]=-\sum _{x\in \mathbb {X} }p(x)\log p(x).}](https://wikimedia.org/api/rest_v1/media/math/render/svg/971ffd75b32f284123036d4ae8fc3dd6e377e030)

![{\displaystyle H(X,Y)=\mathbb {E} _{X,Y}[-\log p(x,y)]=-\sum _{x,y}p(x,y)\log p(x,y)\,}](https://wikimedia.org/api/rest_v1/media/math/render/svg/a10572b1a21187833168e50a998f66856658674d)

![{\displaystyle H(X|Y)=\mathbb {E} _{Y}[H(X|y)]=-\sum _{y\in Y}p(y)\sum _{x\in X}p(x|y)\log p(x|y)=-\sum _{x,y}p(x,y)\log p(x|y).}](https://wikimedia.org/api/rest_v1/media/math/render/svg/7bdf0f6f2421309afb521010957e1e556669e479)

![{\displaystyle I(X;Y)=\mathbb {E} _{X,Y}[SI(x,y)]=\sum _{x,y}p(x,y)\log {\frac {p(x,y)}{p(x)\,p(y)}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/7d86fba391a52b75e1cf36dae6bfaa1ccbccf461)

![{\displaystyle I(X;Y)=\mathbb {E} _{p(y)}[D_{\mathrm {KL} }(p(X|Y=y)\|p(X))].}](https://wikimedia.org/api/rest_v1/media/math/render/svg/d0d90fc72e685981072e77a3933c7ad6c4c83d13)

![Модель каналу {\displaystyle {\xrightarrow[{\text{Повідомлення}}]{W}}{\begin{array}{|c| }\hline {\text{Кодувальник}}\\f_{n}\\\hline \end{array}}{\xrightarrow[{\mathrm {{\text{Закодована}} \atop {\text{послідовність}}} }]{X^{n}}}{\begin{array}{|c| }\hline {\text{Канал}}\\p(y|x)\\\hline \end{array}}{\xrightarrow[{\mathrm {{\text{Отримана}} \atop {\text{послідовність}}} }]{Y^{n}}}{\begin{array}{|c| }\hline {\text{Декодувальник}}\\g_{n}\\\hline \end{array}}{\xrightarrow[{\mathrm {{\text{Гадане}} \atop {\text{повідомлення}}} }]{\hat {W}}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/db182e7f71fcffdd4cf5d30d4ae2fe3d86c917b7)